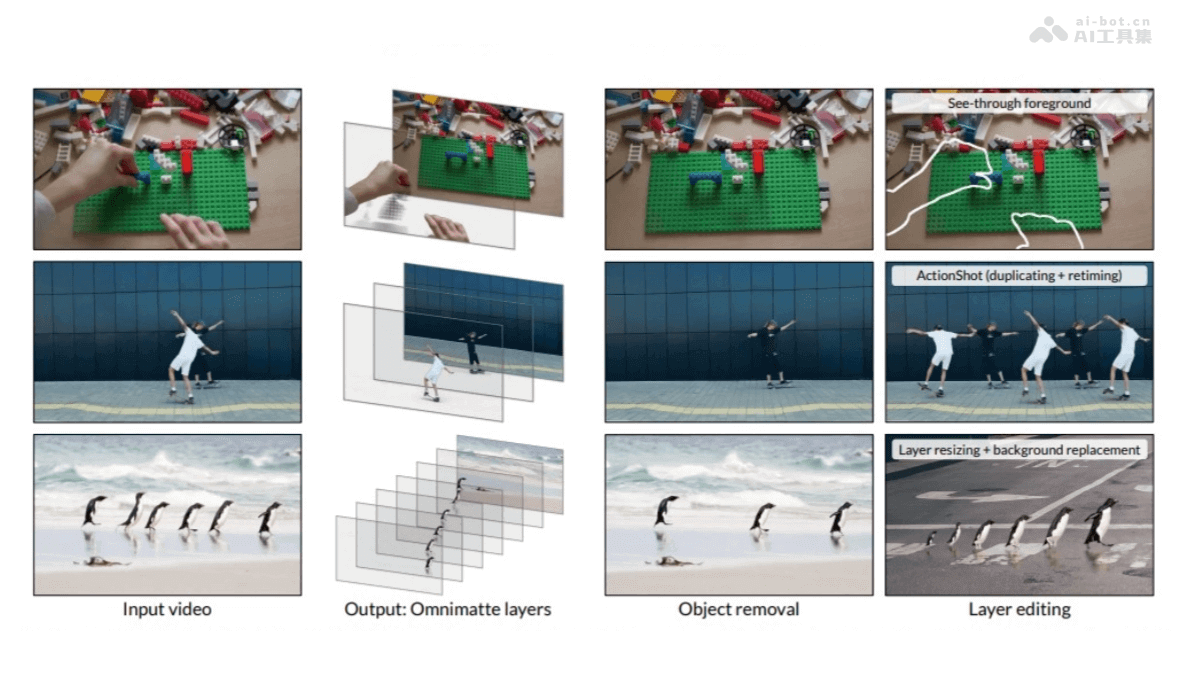

Generative Omnimatte 是 Google DeepMind 等機構推出的視頻編輯技術,能將視頻智能分解為多個透明背景的RGBA圖層,每個圖層對應一個物體及其相關效果(如陰影、反射等)。無需綠幕或深度信息,能實現物體與背景的精確分離,處理被遮擋的部分。Generative Omnimatte的核心是一個名為“Casper”的視頻擴散模型,能精準擦除視頻中的物體及其陰影,同時保持背景完好無損。用戶能輕松實現各種創意效果,如瞬移、改變運動速度,甚至讓時間倒流。

Generative Omnimatte的主要功能視頻分層:將視頻分解成多個 RGBA 層,每個層包含一個完全可見的對象及其相關的效應,如陰影和反射。視頻編輯:支持用戶進行廣泛的視頻編輯操作,包括對象和效應的移除、背景替換等。動態背景處理:處理動態背景,避免背景元素與前景對象層的糾纏。多對象場景:有效處理包含多個對象的場景,包括相似對象的隔離和效應關聯。用戶指定的 Trimask:支持用戶用指定 Trimask 精細控制視頻編輯過程中的保留和移除區域。Generative Omnimatte的技術原理對象效應移除模型 Casper:給定輸入視頻和二進制對象掩碼,用 Casper 模型生成干凈的背景板和一系列單對象(solo)視頻,應用不同的 Trimask 條件。Trimask 條件:Trimask 指定保留(白色)、移除(黑色)和可能包含不確定對象效應(灰色)的區域。有助于精確處理多對象場景。測試時優化:在第二階段,用測試時優化從 solo 視頻和背景視頻對中重建 Omnimatte 層。訓練數據:用多個數據集(Omnimatte、Tripod、Kubric 和 Object-Paste)訓練模型,提供真實視頻的因果關系示例,并增強模型處理多對象場景的能力。自注意力分析:基于分析 Lumiere 模型的自注意力模式,研究文本到視頻(T2V)模型對對象效應關聯的內在理解,訓練有效的對象效應移除模型。Generative Omnimatte的項目地址項目官網:https://gen-omnimatte.github.io/arXiv技術論文:https://arxiv.org/pdf/2411.16683Generative Omnimatte的應用場景電影和視頻制作:在電影制作中,移除不需要的背景元素,或者替換背景,實現特效場景的無縫合成。視頻編輯和后期制作:視頻編輯者分離視頻中的對象和背景,進行顏色校正、特效添加或其他創意編輯。廣告制作:在廣告中,替換產品背景,或移除拍攝中的干擾元素,突出產品。虛擬現實和增強現實:在 VR 和 AR 應用中,將現實世界的視頻內容與虛擬元素結合,提供更加沉浸式的體驗。游戲開發:在游戲制作中,創建復雜的游戲環境,將現實世界的元素與虛擬游戲世界無縫融合。

Generative Omnimatte的主要功能視頻分層:將視頻分解成多個 RGBA 層,每個層包含一個完全可見的對象及其相關的效應,如陰影和反射。視頻編輯:支持用戶進行廣泛的視頻編輯操作,包括對象和效應的移除、背景替換等。動態背景處理:處理動態背景,避免背景元素與前景對象層的糾纏。多對象場景:有效處理包含多個對象的場景,包括相似對象的隔離和效應關聯。用戶指定的 Trimask:支持用戶用指定 Trimask 精細控制視頻編輯過程中的保留和移除區域。Generative Omnimatte的技術原理對象效應移除模型 Casper:給定輸入視頻和二進制對象掩碼,用 Casper 模型生成干凈的背景板和一系列單對象(solo)視頻,應用不同的 Trimask 條件。Trimask 條件:Trimask 指定保留(白色)、移除(黑色)和可能包含不確定對象效應(灰色)的區域。有助于精確處理多對象場景。測試時優化:在第二階段,用測試時優化從 solo 視頻和背景視頻對中重建 Omnimatte 層。訓練數據:用多個數據集(Omnimatte、Tripod、Kubric 和 Object-Paste)訓練模型,提供真實視頻的因果關系示例,并增強模型處理多對象場景的能力。自注意力分析:基于分析 Lumiere 模型的自注意力模式,研究文本到視頻(T2V)模型對對象效應關聯的內在理解,訓練有效的對象效應移除模型。Generative Omnimatte的項目地址項目官網:https://gen-omnimatte.github.io/arXiv技術論文:https://arxiv.org/pdf/2411.16683Generative Omnimatte的應用場景電影和視頻制作:在電影制作中,移除不需要的背景元素,或者替換背景,實現特效場景的無縫合成。視頻編輯和后期制作:視頻編輯者分離視頻中的對象和背景,進行顏色校正、特效添加或其他創意編輯。廣告制作:在廣告中,替換產品背景,或移除拍攝中的干擾元素,突出產品。虛擬現實和增強現實:在 VR 和 AR 應用中,將現實世界的視頻內容與虛擬元素結合,提供更加沉浸式的體驗。游戲開發:在游戲制作中,創建復雜的游戲環境,將現實世界的元素與虛擬游戲世界無縫融合。