這是一種實現(xiàn)場景和對象級運動控制的方法,并用于精確,高質(zhì)量的全方位圖像到視頻生成

(中國AI網(wǎng) 2025年05月05日)隨著虛擬現(xiàn)實技術(shù)的普及,人們對沉浸式動態(tài)全向視頻(ODV)的可控制作需求日益增加。盡管以前的文本到ODV生成方法取得了令人印象深刻的結(jié)果,但由于僅僅依賴文本輸入,它們存在內(nèi)容不準確和不一致的問題。

盡管最近的控制技術(shù)為視頻生成提供了細粒度控制,但直接將相關(guān)方法應(yīng)用于ODV通常會導(dǎo)致空間失真和不滿意的性能,特別是復(fù)雜的球面運動。

為了應(yīng)對相關(guān)挑戰(zhàn),北京大學(xué)和字節(jié)跳動團隊提出了OmniDrag。這是一種實現(xiàn)場景和對象級運動控制的方法,并用于精確,高質(zhì)量的全方位圖像到視頻生成。

在預(yù)訓(xùn)練視頻擴散模型的基礎(chǔ)之上,研究人員引入了一個全向控制模塊。它與時間注意層共同微調(diào),可有效地處理復(fù)雜的球面運動。另外,他們開發(fā)了一種新的球形運動估計器,以準確地提取運動控制信號,并允許用戶通過簡單地繪制手柄和目標點來執(zhí)行拖拽式ODV生成。

團隊同時提出了一個名為Move360的新數(shù)據(jù)集,以解決大型場景和物體運動的ODV數(shù)據(jù)稀缺性。

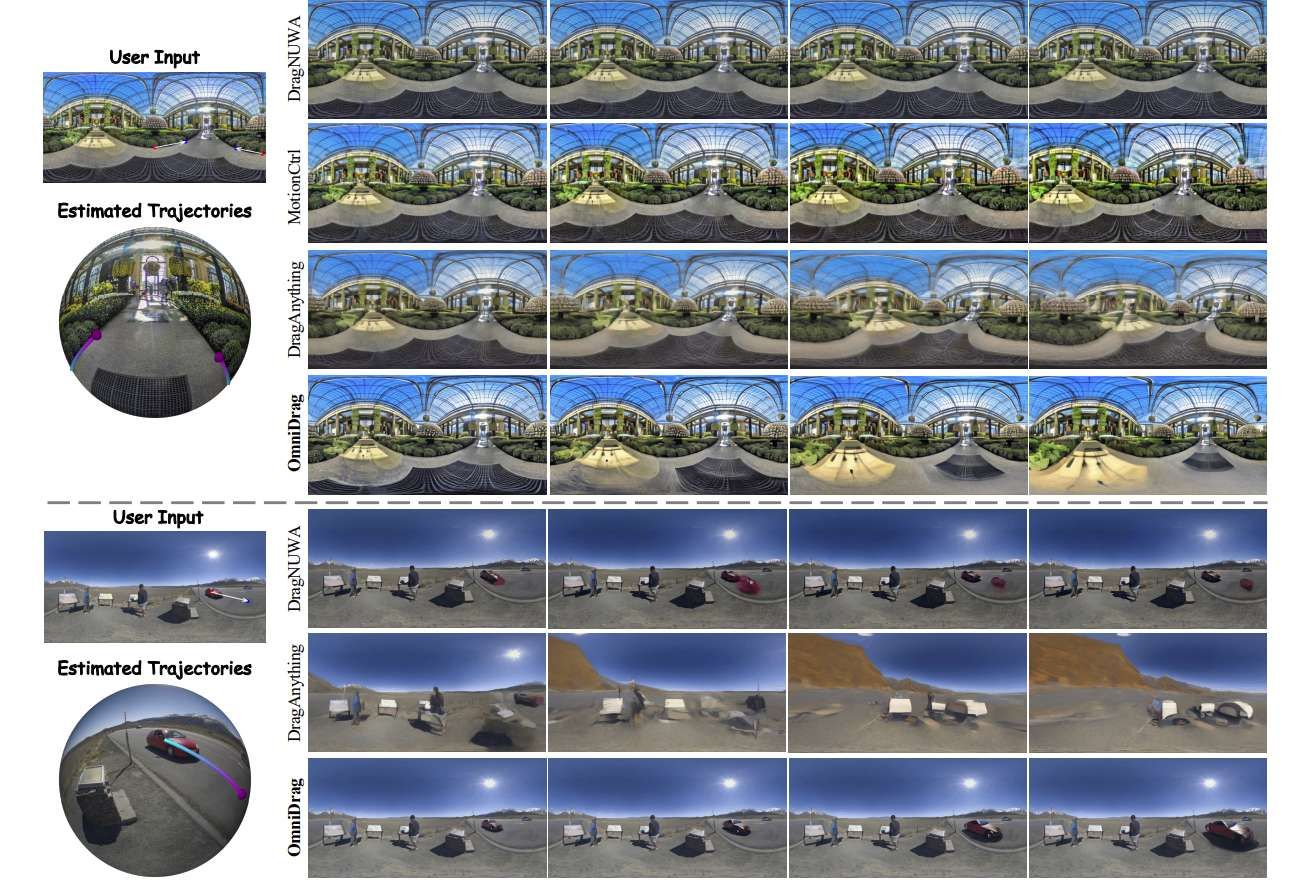

在實驗中,結(jié)果證明了OmniDrag在實現(xiàn)ODV生成的整體場景級和細粒度對象級控制方面的顯著優(yōu)勢。

全向視頻( ODV)又稱為360度或全景視頻,由于其沉浸式和交互能力以及在虛擬和增強現(xiàn)實中的廣泛應(yīng)用而受到越來越多的關(guān)注。

在實際場景中,全向視頻的捕獲流程在時間和硬件資源方面都十分昂貴。所以,迫切需要開發(fā)合適的ODV生成方法。在二維視頻生成領(lǐng)域,大多數(shù)基于擴散的模型都利用大規(guī)模訓(xùn)練數(shù)據(jù)和大量計算資源學(xué)習(xí)到的強大的生成先驗而取得了巨大的成功。對于ODV生成,360DVD引入了一個即插即用的360-Adapter來實現(xiàn)文本到ODV的合成。

然而,這種范式僅僅依賴于文本輸入,往往提供了過于寬泛的生成自由,無法精確確定視頻幀,導(dǎo)致內(nèi)容控制不準確和不一致。盡管360DVD提供了基于光流的控制,但對于用戶而言,獲得ODV光流是一個挑戰(zhàn),從而限制了它的實用性。

最近,基于軌跡的運動控制已經(jīng)成為一種更加用戶友好和有效的可控視頻生成解決方案。與光流或深度圖等其他控制信號相比,繪制軌跡提供了一種簡單而靈活的方法。基于這種方法,諸如DragNUWA、MotionCtrl和DragAnything等將稀疏軌跡或camera運動編碼到latent空間中,以有效引導(dǎo)對象運動。

盡管有所述先進的2D視頻合成方法,但將它們直接應(yīng)用于ODV生成存在三個重大挑戰(zhàn):首先,與控制傳統(tǒng)2D視頻不同,ODV中的運動模式通常是球形,而傳統(tǒng)2D視頻通常涉及簡單的運動。先前在此任務(wù)中應(yīng)用的方法可能導(dǎo)致生成結(jié)果的空間扭曲,因為它們無法模擬復(fù)雜的球面運動。

其次,由于ODV通常以等矩形投影(ERP)格式存儲,控制它們比控制2D視頻更困難,因為在ERP圖像繪制合理而精確的球面運動軌跡對人類用戶來說是一個挑戰(zhàn)。

第三,現(xiàn)有ODV數(shù)據(jù)集包含的樣本運動幅度有限,當(dāng)面對用戶對更大運動范圍的要求時,深度可控ODV生成模型的有效性受到限制。

為了解決所述問題,北京大學(xué)和字節(jié)跳動團隊提出了OmniDrag。這種方法基于強大的預(yù)訓(xùn)練視頻擴散模型實現(xiàn)全方位圖像到視頻生成的運動控制。如圖1所示,OmniDrag通過簡單的用戶輸入實現(xiàn)了高質(zhì)量、可控的ODV生成,使用統(tǒng)一的模型實現(xiàn)了場景級和對象級的拖拽式控制。

在OmniDrag中,團隊引入了一個全向控制器,它將軌跡作為輸入,以提供細粒度的運動可控性。有效地學(xué)習(xí)復(fù)雜的球面運動。

在ODV中,研究人員建議與控制器共同微調(diào)時間注意力組件。為了精確、簡便地控制運動,他們開發(fā)了一種新的球面運動估計器(SME)。在訓(xùn)練過程中,SME使用等面積等緯度球面點初始化追蹤目標運動,并通過基于球面距離的濾波器進行采樣,均勻準確地捕獲重要運動。

在推理過程中,SME通過球面插值估計運動軌跡,允許用戶只提供手柄和目標點。另外,團隊引入了一個名為Move360的高質(zhì)量ODV數(shù)據(jù)集,其具有顯著的場景級和對象級運動。Move360包含1500多個不同場景的視頻片段,由安裝在拍攝車的Insta360 Titan拍攝。實驗表明,在Move360的訓(xùn)練增強了OmniDrag的場景級移動能力。

為了驗證OmniDrag中提出的組件的有效性,團隊進行了實驗研究。團隊通過只在WEB360數(shù)據(jù)集訓(xùn)練OmniDrag來評估另一個變體。盡管變體獲得了更好的FID結(jié)果,但其運動控制性能較差。

結(jié)果進一步說明,若沒有包含高質(zhì)量運動的數(shù)據(jù)集的訓(xùn)練,由于運動多樣性不足,模型無法提供場景級的可控性。相比之下,使用Move360數(shù)據(jù)集進行訓(xùn)練可以實現(xiàn)準確和穩(wěn)定的場景級控制,顯著增強模型的功能。

相關(guān)論文:OmniDrag: Enabling Motion Control for Omnidirectional Image-to-Video Generation

總的來說,OmniDrag是一種基于擴散的方法,用于在全方位圖像到視頻生成中實現(xiàn)運動控制。他們引入了一個Omni控制器,它接收球面軌跡作為輸入,允許簡單的拖拽式控制。

為了有效地學(xué)習(xí)復(fù)雜的球面運動模式,研究人員提出在擴散去噪UNet中對控制器和時間層進行聯(lián)合微調(diào)。另外,他們設(shè)計了一個球形運動估計器,以在訓(xùn)練過程中捕獲準確的控制信號,并在推理過程中提供用戶友好的交互。

同時,Move360這個新的高質(zhì)量ODV數(shù)據(jù)集具有重要的運動內(nèi)容,增強了OmniDrag的場景級可控性。實驗表明,OmniDrag在場景和對象級運動控制方面都達到了最先進的性能。

當(dāng)然,盡管OmniDrag取得了令人滿意的結(jié)果,但在特定場景下,其生成質(zhì)量受到基本SVD模型的約束。另外,解耦camera和對象級運動是未來研究的一個開放問題。

項目頁面請訪問這里。