能夠?qū)F(xiàn)有數(shù)據(jù)集增強(qiáng)為具有各種手-物體姿態(tài)和視點(diǎn)的大規(guī)模逼真數(shù)據(jù)

(中國(guó)AI網(wǎng) 2025年05月16日)對(duì)人機(jī)交互的理解在虛擬現(xiàn)實(shí)等應(yīng)用中起著重要的作用。然而,由于手和物體之間的明顯遮擋以及高自由度運(yùn)動(dòng),收集和注釋高質(zhì)量的大規(guī)模數(shù)據(jù)集是一項(xiàng)挑戰(zhàn),阻礙了雙手與物體交互相關(guān)基線的進(jìn)一步改進(jìn)。

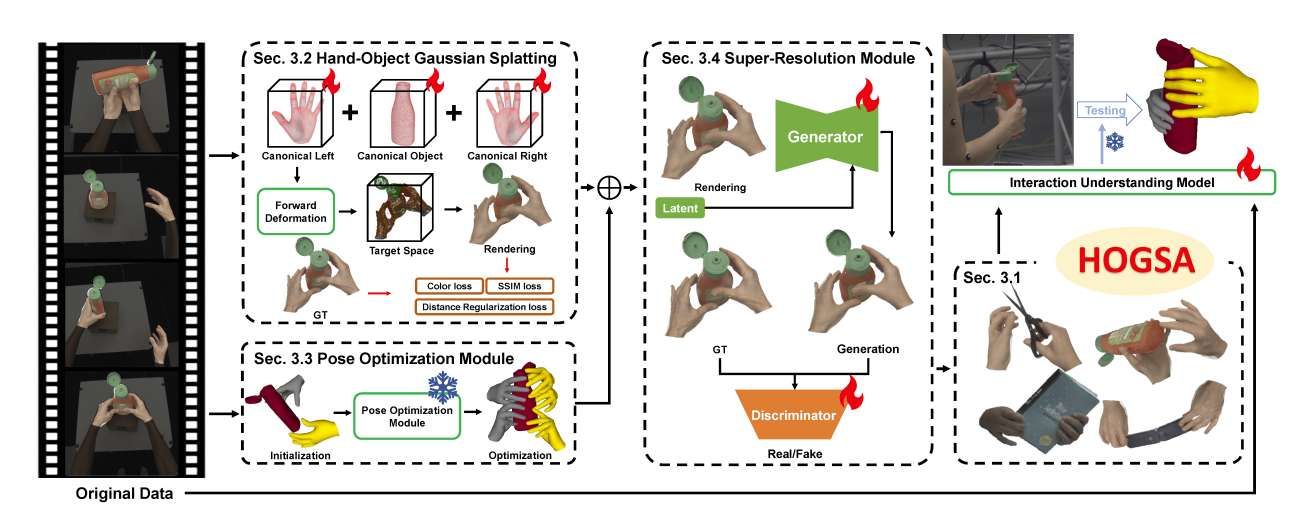

在一項(xiàng)研究中,中國(guó)科學(xué)院,中國(guó)科學(xué)院大學(xué)和谷歌團(tuán)隊(duì)提出了一種基于3DGS的手工手-物體交互數(shù)據(jù)增強(qiáng)框架,而它能夠?qū)F(xiàn)有數(shù)據(jù)集增強(qiáng)為具有各種手-物體姿態(tài)和視點(diǎn)的大規(guī)模逼真數(shù)據(jù)。

首先,使用基于網(wǎng)格的3DGS對(duì)物體和手進(jìn)行建模,并設(shè)計(jì)了一個(gè)超分辨率模塊來解決多分辨率輸入圖像導(dǎo)致的渲染模糊問題。

其次,團(tuán)隊(duì)擴(kuò)展了針對(duì)雙手物體的單手抓取姿態(tài)優(yōu)化模塊,生成了雙手物體交互的各種姿態(tài),以顯著擴(kuò)展數(shù)據(jù)集的姿態(tài)分布。第三,研究人員分析了所提出的數(shù)據(jù)增強(qiáng)的不同方面對(duì)理解雙手-物體交互的影響。

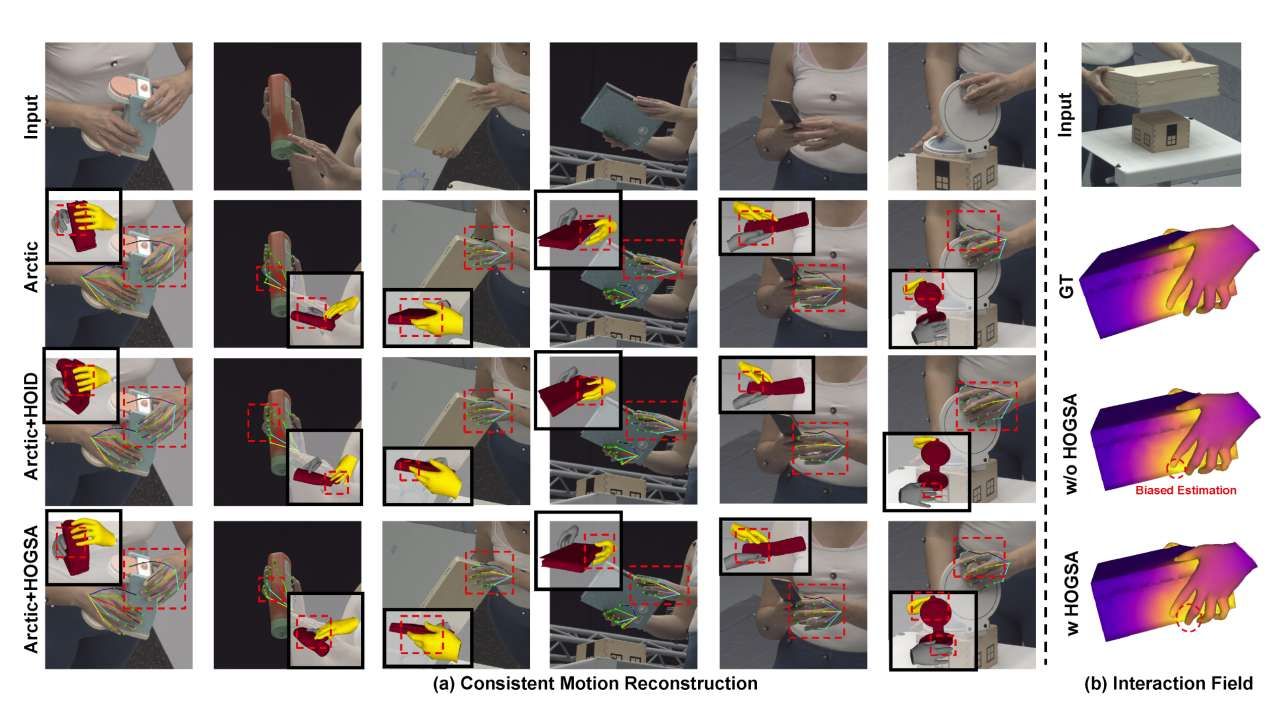

他們?cè)贖2O和Arctic兩個(gè)基準(zhǔn)執(zhí)行了數(shù)據(jù)增強(qiáng),并驗(yàn)證了所述方法可以提高基線的性能。

對(duì)手動(dòng)手-物交互的理解,尤其是手-物體姿態(tài)和接觸關(guān)系的估計(jì),在虛擬現(xiàn)實(shí)應(yīng)用等中發(fā)揮著越來越重要的作用。解決這一問題的最流行方法之一是基于深度學(xué)習(xí)的方法,但它需要大規(guī)模的手動(dòng)手-對(duì)象交互數(shù)據(jù)集和豐富的注釋。

由于人機(jī)交互的明顯遮擋和高自由度運(yùn)動(dòng),收集和注釋高質(zhì)量的數(shù)據(jù)集依然具有挑戰(zhàn)性,阻礙了任務(wù)的進(jìn)一步改進(jìn)。

為了解決數(shù)據(jù)稀缺性和不準(zhǔn)確的3D注釋的挑戰(zhàn),業(yè)界已經(jīng)探索了在傳統(tǒng)渲染管道下使用合成數(shù)據(jù)的數(shù)據(jù)增強(qiáng)方法。然而,所述方法通常需要復(fù)雜和耗時(shí)的3D掃描和后處理來捕獲手和物體的高質(zhì)量形狀和紋理圖,并且需要額外的手模型混合權(quán)重來增強(qiáng),而這需要大量的專業(yè)知識(shí)。

另外,從觀察到的圖像中捕獲逼真的紋理映射(即微妙的細(xì)節(jié)和手和物體的自然外觀)十分困難,所以經(jīng)常導(dǎo)致手和物體的渲染結(jié)果缺乏真實(shí)感。

最近,得益于場(chǎng)景表示能力,NeRF等神經(jīng)渲染方法通過合成新穎視圖或新穎手部姿勢(shì)實(shí)現(xiàn)了高質(zhì)量的數(shù)據(jù)增強(qiáng)。NeRFmentation則使用NeRF對(duì)靜態(tài)場(chǎng)景下的單目深度估計(jì)任務(wù)進(jìn)行數(shù)據(jù)增強(qiáng),但在場(chǎng)景發(fā)生顯著變化時(shí)無法突破精度瓶頸。

HO-NeRF為手-物體交互場(chǎng)景構(gòu)建了一個(gè)姿態(tài)驅(qū)動(dòng)的NeRF,并展示了生成多種數(shù)據(jù)的潛力,但它需要對(duì)手和物體進(jìn)行離線建模,并且渲染過程耗時(shí),所以不適合大規(guī)模數(shù)據(jù)集的數(shù)據(jù)增強(qiáng)。

盡管神經(jīng)渲染方法可以支持逼真的新視圖合成,并且可能對(duì)數(shù)據(jù)增強(qiáng)有用,但由于多分辨率圖像輸入和不準(zhǔn)確的注釋,它們依然存在圖像模糊的問題。不真實(shí)的圖像不能解決真實(shí)圖像和合成圖像之間的差距,并將導(dǎo)致模型性能的下降。

影響基線性能的另一個(gè)關(guān)鍵因素是數(shù)據(jù)集中姿勢(shì)的多樣性。所以,有必要建立一種雙手手物交互的數(shù)據(jù)增強(qiáng)方法,以實(shí)現(xiàn)高效的渲染,各種可行的手物姿態(tài),以及逼真的渲染圖像。

在研究中,中國(guó)科學(xué)院,中國(guó)科學(xué)院大學(xué)和谷歌團(tuán)隊(duì)提出了一個(gè)基于3DGS的數(shù)據(jù)增強(qiáng)框架HOGSA,并用于手動(dòng)手-對(duì)象交互理解。

首先,基于手-物交互圖像,采用基于網(wǎng)格的3DGS方法對(duì)手和物體進(jìn)行建模,這可以有效地綜合輸入手-物位姿和視點(diǎn)的交互圖像。其次,為了增強(qiáng)數(shù)據(jù)集的姿態(tài)多樣性,使用姿態(tài)優(yōu)化模塊生成雙手和物體的不同姿態(tài),驅(qū)動(dòng)手-物體高斯飛濺模型渲染新的交互姿態(tài)圖像。

第三,為了保證渲染圖像的真實(shí)感,團(tuán)隊(duì)設(shè)計(jì)了超分辨率模塊來提高3DGS生成的粗糙圖像的渲染質(zhì)量。最后,將增強(qiáng)數(shù)據(jù)集與原始數(shù)據(jù)集相結(jié)合,細(xì)化了雙手-物體交互的基線,并對(duì)增強(qiáng)數(shù)據(jù)集中影響交互理解精度的各個(gè)方面進(jìn)行了系統(tǒng)分析。

團(tuán)隊(duì)在兩個(gè)主要基準(zhǔn)H2O 和Arctic 評(píng)估了所提出的方法,并且通過增強(qiáng)數(shù)據(jù)集提高了基線性能。

相關(guān)論文:HOGSA: Bimanual Hand-Object Interaction Understanding with 3D Gaussian Splatting Based Data Augmentation

總的來說,團(tuán)隊(duì)提出了一個(gè)基于3DGS 的手-物體交互數(shù)據(jù)增強(qiáng)框架,它可以將現(xiàn)有的基準(zhǔn)增強(qiáng)到具有各種手-物體姿態(tài)和視點(diǎn)的大規(guī)模真實(shí)感數(shù)據(jù)。擴(kuò)展后的數(shù)據(jù)集可以進(jìn)一步提高現(xiàn)有基線的性能。

所提出了姿態(tài)優(yōu)化模塊來生成各種物理上可行的手動(dòng)手物交互姿態(tài),以及通過超分辨率模塊來提高使用3DGS渲染圖像的真實(shí)感。團(tuán)隊(duì)在H2O和Arctic兩個(gè)基準(zhǔn)執(zhí)行了數(shù)據(jù)增強(qiáng),并驗(yàn)證了所提出方法可以提高基線的性能。