3D重建

(中國AI網(wǎng) 2025年07月16日)3D高斯飛濺可以在實(shí)時(shí)幀率下實(shí)現(xiàn)高質(zhì)量的新穎視圖合成(NVS)。但當(dāng)我們偏離訓(xùn)練視圖時(shí),它的質(zhì)量就會(huì)急劇下降。所以需要密集捕獲來匹配特定應(yīng)用的高質(zhì)量期望,例如虛擬現(xiàn)實(shí)。然而,如此密集的捕獲非常費(fèi)力和昂貴。業(yè)界已經(jīng)探索了使用2D生成模型通過蒸餾或生成額外的訓(xùn)練視圖來減輕這一要求。但它們通常僅以少數(shù)參考輸入視圖為條件,因此不能充分利用可用的3D信息,從而導(dǎo)致不一致的生成結(jié)果和重建偽影。

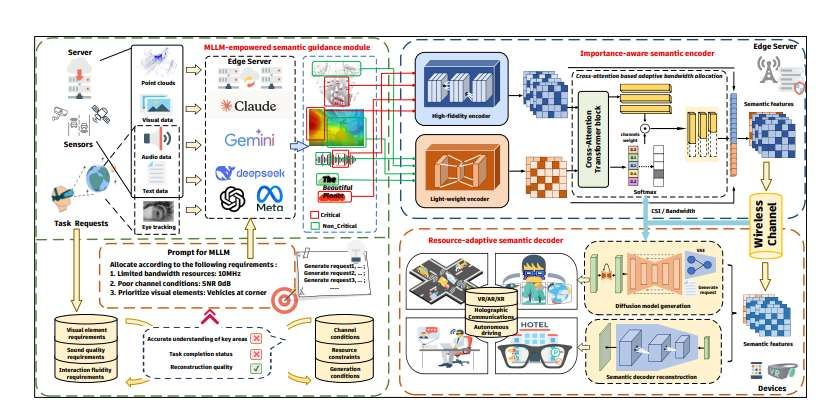

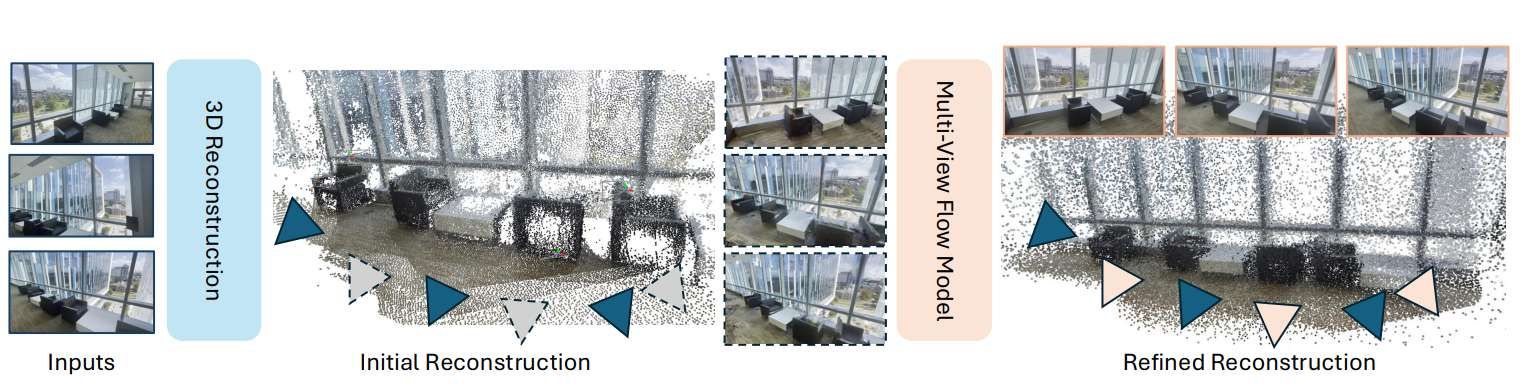

為了解決這個(gè)問題,蘇黎世聯(lián)邦理工學(xué)院,Meta和卡內(nèi)基梅隆大學(xué)團(tuán)隊(duì)提出了一個(gè)多視圖流匹配(flow matching)模型。它學(xué)習(xí)一個(gè)流,將可能是稀疏重建的新視圖渲染結(jié)果與期望的密集重建渲染結(jié)果連接起來。

這使得可以用新生成的視圖來增強(qiáng)場(chǎng)景采集,從而提高重建質(zhì)量。模型是在一個(gè)360萬圖像對(duì)的新數(shù)據(jù)集訓(xùn)練,可以在一張H100 GPU以540 × 960分辨率(91K令牌)處理多達(dá)45個(gè)視圖。管道在稀疏和密集視圖場(chǎng)景下不斷改進(jìn)NVS,從而在多個(gè)廣泛使用的NVS基準(zhǔn)測(cè)試中獲得比以前更高質(zhì)量的重建。

3D重建是從一組2D圖像中估計(jì)3D場(chǎng)景的幾何形狀和外觀的過程。給定一個(gè)足夠大且足夠密集的3D場(chǎng)景圖像集,現(xiàn)代3D重建方法,如神經(jīng)輻射場(chǎng)(NeRF)和3D高斯飛濺(3DGS),可以以如此高的質(zhì)量重建3D場(chǎng)景,以至于所得到的3D表示可以渲染成幾乎與現(xiàn)實(shí)無法區(qū)分的新視圖。這是新視角合成(NVS)的任務(wù),它可以實(shí)現(xiàn)各種應(yīng)用,例如在逼真的真實(shí)場(chǎng)景中實(shí)現(xiàn)沉浸式VR體驗(yàn)。

然而,為了達(dá)到這樣的結(jié)果,對(duì)于給定的3D場(chǎng)景,需要極其大量的捕獲圖像。捕獲如此大量的圖像十分費(fèi)力的,而且并不總是可能。因此,3D重建和新視圖合成的核心挑戰(zhàn)之一是如何構(gòu)建一種可以用更少圖像獲得同樣好的結(jié)果,同時(shí)能夠利用大量可用的圖像集的算法。

在研究中,蘇黎世聯(lián)邦理工學(xué)院,Meta和卡內(nèi)基梅隆大學(xué)團(tuán)隊(duì)提出了FlowR方法來解決這個(gè)問題。FlowR由兩部分組成:

基于3DGS的魯棒初始重建管道,但設(shè)計(jì)用于稀疏和密集視圖設(shè)置。他們使用MASt3R來估計(jì)追蹤對(duì)應(yīng),然后將其用于三角測(cè)量初始點(diǎn)云;

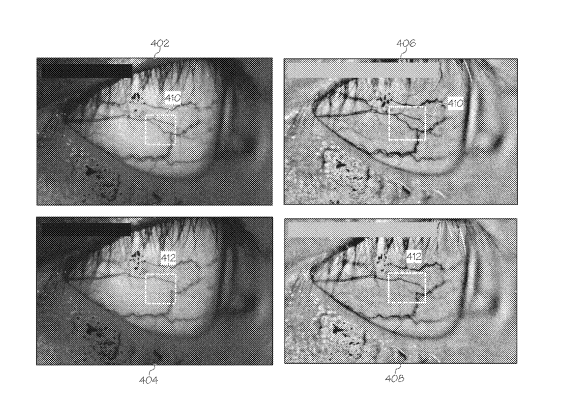

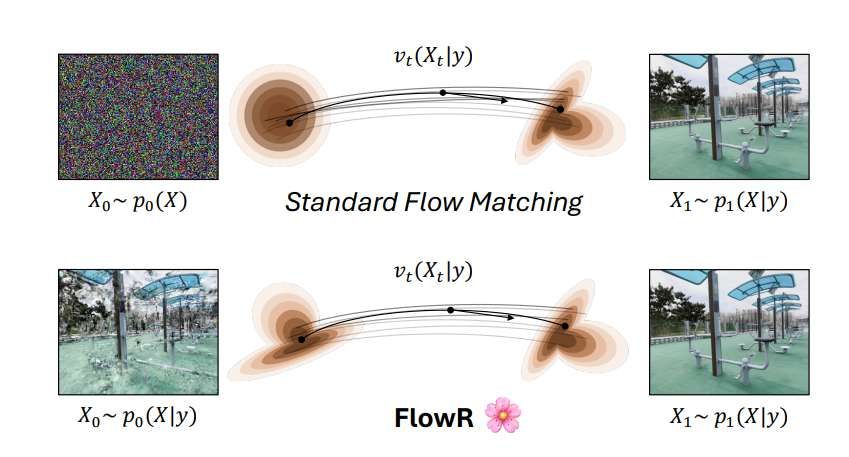

數(shù)據(jù)致密化過程,使用流匹配生成高質(zhì)量的額外視圖,并用于改進(jìn)重建。團(tuán)隊(duì)不是對(duì)噪點(diǎn)和數(shù)據(jù)之間的速度場(chǎng)進(jìn)行建模,而是對(duì)不正確的新視圖渲染圖和該視點(diǎn)各自的真實(shí)圖像之間的速度場(chǎng)進(jìn)行建模(見圖1)。通過這種方式,如果已經(jīng)有足夠密集的輸入圖像,初始重建對(duì)于特定視圖來說足夠好,則流匹配模型可以簡單地學(xué)習(xí)而不改變輸入。這保證了生成模型不會(huì)產(chǎn)生與現(xiàn)有場(chǎng)景內(nèi)容不一致和沖突的不必要新細(xì)節(jié),而是產(chǎn)生清晰的場(chǎng)景細(xì)節(jié),避免了不一致代的平均值模糊。

流匹配模型使用單個(gè)多視圖擴(kuò)散轉(zhuǎn)換器同時(shí)生成N張圖像,以確保所有生成的圖像彼此一致,同時(shí)將這N張圖像的生成與初始重建的M張輸入圖像進(jìn)行調(diào)節(jié),以確保新生成的視圖與輸入視圖一致。為了訓(xùn)練模型,研究人員使用魯棒初始重建方法創(chuàng)建了一個(gè)包含10.3萬個(gè)重建場(chǎng)景的數(shù)據(jù)集,從中獲得了360萬對(duì)具有相應(yīng)ground truth圖像的新視圖重建。

他們利用流匹配來提高初始重建的新視圖渲染的質(zhì)量,并作為輔助訓(xùn)練數(shù)據(jù)來適應(yīng)改進(jìn)的3D表示。所述方法可能適用于不同的場(chǎng)景表示,而采用高斯基元非常方便,因?yàn)樗鼈兛梢钥焖儆?xùn)練。事實(shí)上,由于這一解決方案屬于數(shù)據(jù)驅(qū)動(dòng),團(tuán)隊(duì)需要構(gòu)建不同稀疏度級(jí)別下的重建數(shù)據(jù)集,高斯飛濺確保了為此目的更好的可擴(kuò)展性。

如圖所示,給定一組源輸入圖像(藍(lán)色),使用魯棒重建方法創(chuàng)建一個(gè)初始重建結(jié)果,而結(jié)果可以在不同的角度(灰色)進(jìn)行渲染。他們使用渲染圖作為流匹配模型的源樣本,模型將渲染圖像映射到目標(biāo)分布,即ground truth圖像。然后使用生成的視圖(橙色)來提高重建的質(zhì)量。

相關(guān)論文:FlowR: Flowing from Sparse to Dense 3D Reconstructions

https://arxiv.org/pdf/2504.01647

總的來說,F(xiàn)lowR這種新穎管道可以在稀疏和密集的3D重建之間架起橋梁。所提出方法通過學(xué)習(xí)將不正確的渲染圖匹配到相應(yīng)的真實(shí)圖像來增強(qiáng)NVS。通過對(duì)360萬對(duì)圖像的大規(guī)模數(shù)據(jù)集進(jìn)行訓(xùn)練,F(xiàn)lowR在稀疏和密集視圖場(chǎng)景下都顯著提高了3DGS的性能,優(yōu)于之前僅依賴2D條件合成的生成方法。