弱監督的3D檢測

(中國AI網 2025年07月28日)單目三維目標檢測是計算機視覺中的一項重要任務,在虛擬現實和增強現實等領域有著廣泛的應用。然而,3D目標檢測器通常以完全監督的方式進行訓練,廣泛依賴于3D標記數據,而這是一種勞動密集型且昂貴的注釋。

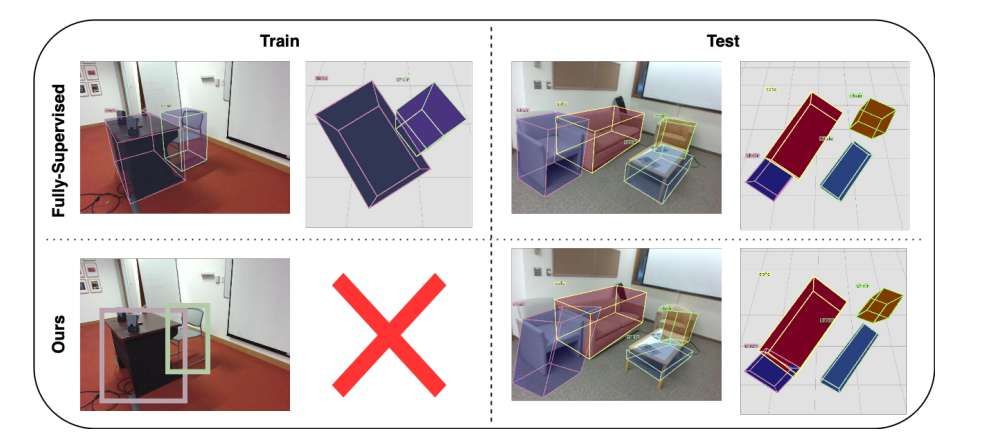

在一項研究中,丹麥技術大學團隊把目光放在弱監督的3D檢測,以減少數據需求,并使用單目方法,利用單攝像頭系統,而不是昂貴的激光雷達傳感器或多攝像頭設置。

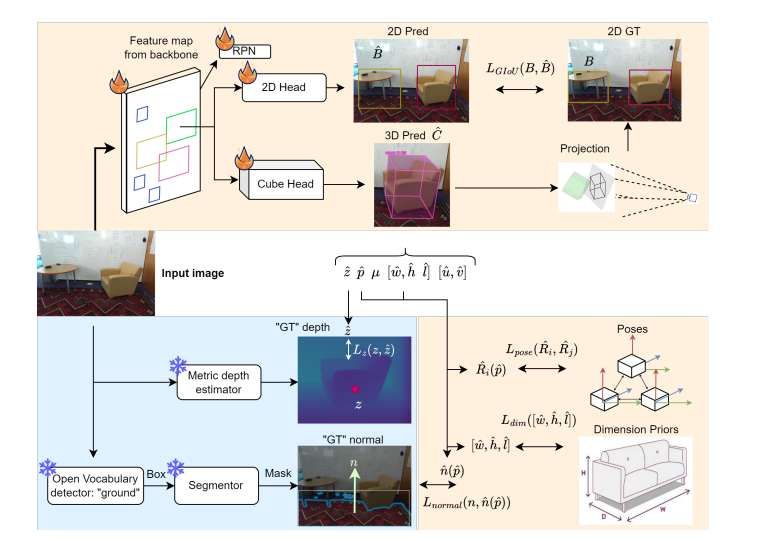

研究人員提出了一種通用模型Weak Cube R-CNN,它利用三維立方體的二維投影之間的關系,只需要二維方框注釋進行訓練,就可以在推理時預測三維對象。所提出方法利用預訓練的frozen foundation 2D模型來估計訓練集的深度和方向信息,并在訓練中使用估計值作為pseudo-ground truth。所設計的損失函數通過將外部模型的信息整合到損失中來避免3D標簽。

通過這種方式,團隊的目標是隱式地從large foundation 2D模型中轉移knowledge,而無需訪問3D邊界框注釋。在SUN RGB-D數據集的實驗結果表明,與標注時間均衡的Cube R-CNN基線相比,準確度有所提高。盡管對厘米級測量不精確,但所述方法為進一步的研究提供了堅實的基礎。

分辨物體的大小、距離和深度是人類和動物的一種非常自然的能力。因此,在三維空間中放置物體是一項容易完成的任務。然而,大多數數碼照片都是用單目攝像頭拍攝,無法享受到同樣的立體效果。盡管如此,圖像中依然存在諸多深度和大小線索。3D對象探測器可以很好地拾取許多深度線索。

在物理空間中以精確尺寸定位物體的能力為增強現實等領域提供了新的用例。然而,由于對特殊物理傳感器的要求,收集3D注釋數據集具有挑戰性。例如,為了注釋3D數據集SUN-RGBD,需要花費2051小時,而這只是是一個非常小的數據集,只有10,335張圖像。這相當于每張圖像大約需要12分鐘,而2D注釋需要65分鐘(≈9%)。這還不包括額外的數據收集時間。

另一方面,業內存在豐富的2D注釋數據集可以利用。這激發了僅依賴于2D注釋的3D檢測器的開發。其他研究通過在推理過程中使用額外的傳感器來解決這個問題,主要是激光雷達,偽激光雷達和立體攝像頭,因為它們提供了3D空間的準確表示。相關系統大多用于簡化的駕駛場景,其中視覺線索是穩定的,亦即很容易判斷世界的方向,因為有一個大的、無遮擋的地面視圖,并且只需要估計圍繞一個軸的旋轉。

但在更廣義的環境中,相關線索并不一定存在。因此,丹麥技術大學團隊提出了一種基于CNN的模型,而它在訓練過程中只使用2D標注數據來進行3D目標檢測。模型預測對象在圖像平面上的位置,然后通過使用僅使用2D ground truth的“弱損失”來學習將對象放置在3D中。

這一步的關鍵部分是使用基礎模型來估計深度和地平面。模型的輸出用作弱損失的pseudo ground truth值。團隊使用更快的R-CNN類型架構來首先預測對象的2D邊界框。然后,通過從3D head中使用的骨干特征圖中池化來預測3D立方體,將盒子的位置用作3D立方體的候選區域。

除了3D head外,研究人員同時使用了度量深度估計模型的信息來估計深度和地平面,并且優化三維立方體的參數,使二維和三維屬性保持一致。圖像平面定位采用廣義IoU損失。pseudo ground truth深度從圖像推斷的深度圖中采樣。另外,對象大小先驗通過relaxed loss合并,這確保了特定類中的對象大小大致匹配同一類的平均大小對象。

為了估計旋轉,Pose Alignment Loss對場景內部的對象進行操作,并使用對象通常在一個或多個軸對齊的假設。法向量損失確保了與地面的旋轉一致性,這提供了一個世界參考框架。實驗結果表明,與標注時間均衡的Cube R-CNN基線相比,SUN RGB-D的準確率有所提高。

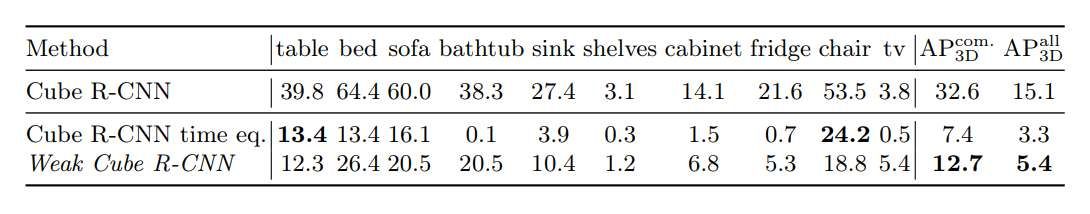

團隊進行燒蝕實驗來研究每個損失項對模型的影響。結果表明,與相應的標注時間均衡模型相比,模型表現良好。表1是Weak Cube R-CNN的損失函數。可以觀察到,當增加損失時,精度有所提高,最明顯的是Ldim,它將AP3D提高了3.1%。Ldim的初始損失很大,然后迅速減小到0。Lpose的影響最小,這在直覺上是有道理的,因為這種損失強制匹配,但不一定是正確的旋轉。

值得注意的是,刪除Lz不會對性能產生很大的影響。在檢查預測時,許多2D比3D看起來要好得多,但IoU依然很低。這主要是由于深度不正確。所以團隊得出結論,Lz不能完美地作為真實深度損失的代表,但依然對總體預測有積極影響。表1中的消融與假設相矛盾,即地面為場景提供了一個旋轉框架。

為了驗證所提出方法,團隊進行了更多的實驗。如表3所示,結果表明,使用Lnormal的模型在旋轉方面更好。這表明Lnormal確實具有預期的效果。因為他們想要專注于確保正確的旋轉,所以在最終模型中包含了Lnormal。

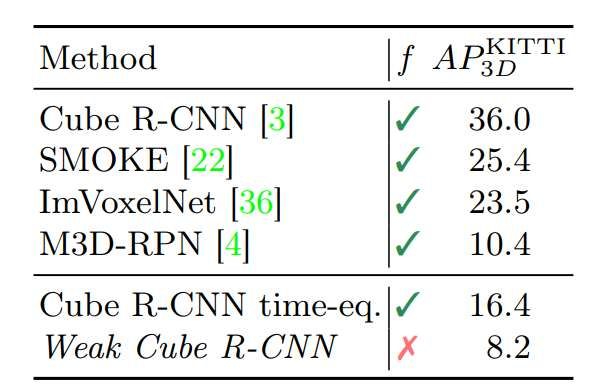

與完全監督的Cube R-CNN方法相比,Weak Cube R-CNN的性能約為表2所示的1/3。在對所有類別進行評估時,AP3D從15.1%下降到5.4%。與同等標注時間的比較。Weak Cube R-CNN的目標是減少標注時間。當使用完全注釋的3D數據但在SUN RGB-D mini上訓練時,團隊將所提出方法與Cube R-CNN進行了比較。

表2表明,所提出方法在許多類別中都超過了基準性能,與Cube R-CNN相比,它達到了+5.3%的平均AP。很明顯,Cube R-CNN的時間等式受到特定類別的極少數樣本的極大阻礙。不出所料,Cube - CNN在所有類別中都優于這兩種模型。然而,考慮到注釋時間大約多11倍,它并沒有達到Weak Cube R-CNN的11倍性能。

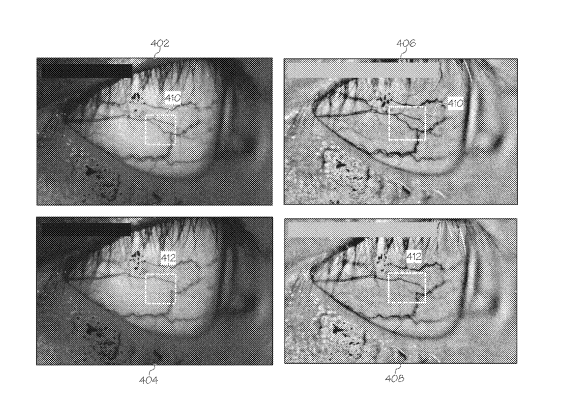

當觀察圖4中的定性結果時,可以看到對于室內場景,簡單場景的預測通常更清晰。在有許多物體和遮擋物體的場景中,它通常會顯得掙扎。總的來說,深度似乎是相當準確的預測,這可以在最后一排看到。姿態對齊似乎確實提高了整體檢測精度,但使更難的情況變得更加困難。像櫥柜這樣沒有扎根于地面的物體幾乎都很難被探測到。

與室內數據集相比,KITTI提供的優勢是地面更加一致可見,所以預計旋轉更容易確定。對于室外場景該模型在正面視圖下的預測效果一般都很好,如圖5所示。但在俯視圖中,可以看到深度經常是錯誤的。表4顯示,Weak Cube R-CNN接近于實現與完全監督方法M3D-RPN相同的精度,但即使是時間均衡的Cube R-CNN都比它高出2倍。KITTI和SUN RGB-D之間的主要區別是深度,這似乎是Weak Cube R-CNN最難解決的問題。

相關論文:Weak Cube R-CNN: Weakly Supervised 3D Detection using only 2D Bounding Boxes

https://arxiv.org/pdf/2504.13297

總的來說,Weak Cube R-CNN是一種僅依賴于單視圖圖像和2D圖像注釋的3D對象檢測新方法。所提出方法克服了3D目標檢測最突出的限制,即數據集的注釋可用性,通過利用較弱的監督,同時依然獲得有競爭力的性能。Weak Cube R-CNN對具有高可見度和簡單幾何結構的物體具有很強的檢測能力。值得注意的是,在SUN-RGBD數據集上,給定相同的標注時間,它比使用3D標注邊界框標注訓練的完全監督Cube R-CNN模型取得了更好的性能。