機器人+VR

(中國AI網 2025年08月04日)機器人領域已經開始利用虛擬現實來提高遠程操作系統的精度和沉浸感,而這顯著優于依賴2D攝像頭輸入和操縱桿控制的傳統方法。盡管取得了進步,但挑戰依然存在,特別是在不同設置的用戶體驗方面。

在一項研究中,倫敦大學學院團隊介紹了一種基于虛擬現實技術的移動平臺機器人遠程操作框架。相關方法的核心是應用高斯飛濺,從而實現更直觀和身臨其境的交互。其中,用戶可以在虛擬場景中導航和操作,就像與真實的機器人互動一樣,以提高遠程操作任務的參與度和效率。

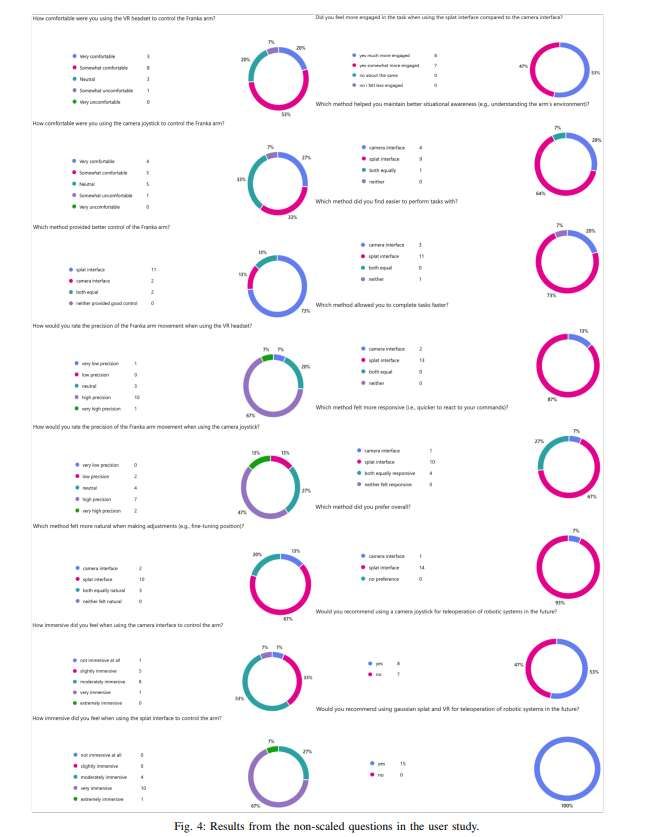

廣泛的用戶研究驗證了所提出方法,展示了顯著的可用性和效率改進。三分之二(66%)的被試可以更快地完成任務,平均減少了43%的時間。另外,93%的受訪者總體上更喜歡高斯飛濺接口,并一致(100%)推薦未來使用,突出了精度、響應能力和態勢感知方面的改進。最后,團隊通過兩個不同應用場景的真實世界實驗證明了框架的有效性,展示了基于高斯飛濺的VR界面的實用功能和多功能性。

機器人遠程操作系統的進步是人類能力擴展到遠程或危險環境的核心。傳統的遠程操作界面通常只依賴于基于操縱桿的控制和來自攝像頭的視覺反饋,而兩者都有固有的局限性,會降低精度和沉浸感。盡管虛擬現實和增強現實在機器人遠程操作環境中的應用取得了重大進展,但依然有大量未開發的潛力可以進一步增強系統。

有數個框架旨在解決機器人局部操作任務的各個方面,并定義為在環境中移動并與場景中存在的對象動態交互的能力。然而,相關框架往往缺乏與先進的VR技術的全面集成。為了彌補這一差距,倫敦大學學院團隊引入了一個專門為局部操作任務設計的全面框架。

具體來說,他們介紹了一種新的遠程操作框架,通過結合先進的VR與高斯飛濺來提高任務的精度和效率。與依賴視覺反饋的傳統VR界面不同,所提出方法利用(但不限于)高斯飛濺來創建遠程環境的高保真度。這種渲染技術不僅提供了更深的空間一致性,而且允許操作員能夠在VR環境中自由調整他們的視點,極大地幫助了需要精確操作的任務。

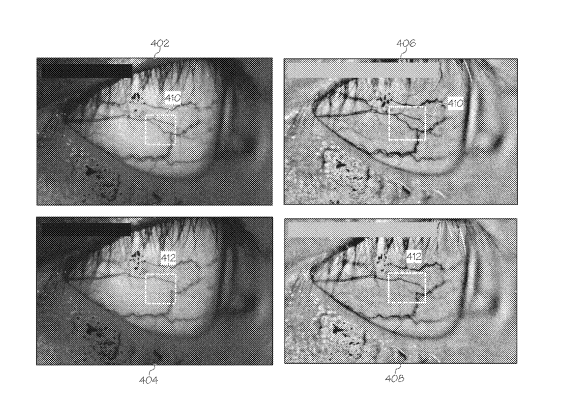

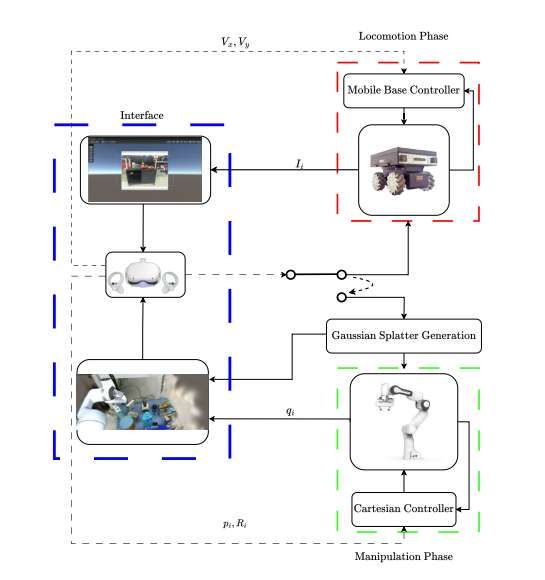

框架采用雙階段策略:初始導航使用帶有運動視覺反饋的傳統控制界面,然后是VR環境中的詳細操作任務,如圖1所示。在這里,操作員可以直接操縱機器人手臂的虛擬表示,允許直觀的控制,因為他們只需在VR空間中拖動模型。這種方法增強了操作者的臨場感和參與感,提高了遠程操作的精度。結果在用戶研究中得到量化,測試了VR界面的有效性和直觀性。將界面與簡單的基線進行比較,在復雜的視覺障礙場景中通過拾取和放置任務展示了所提出系統的優勢。

框架以兩種不同的模式運行:運動階段和操作階段(見圖2)。最初,系統在運動階段發揮作用,其中人類操作員使用遠程操作界面控制機器人。在這種模式下,操作員利用機器人的視頻饋送,結合VR控制器,將機器人導航到所需的操作地點。一旦機器人到達目標位置,操作員開始操作階段,在此期間可以通過VR界面遠程操作機械臂。

為了實現這一點,生成高斯飛濺以創建VR環境中操作場景的精確副本,以及機械手的對齊模型。這為用戶提供了一個完全身臨其境的VR表示,方便用戶與現實世界的互動。

虛擬現實界面操作人員通過虛擬現實界面與系統進行交互。主要控制機制由操縱桿輸入組成,用于在操作階段之間切換,并指揮機器人和機械手。相位切換是通過操縱桿的物理輸入來控制,而不是在VR環境中,這可以確保用戶在虛擬空間中的動作不會無意中干擾系統的相位轉換。

高斯飛濺是作為Unity場景中的視覺效果實現。由于高斯散射是點云的神經渲染,它自然適合通過基于節點的粒子系統(如Unity的VFX圖形)來實現。Unity引擎通過機器人操作系統(ROS)與機器人和操作手進行通信。機器人的機載計算機擁有一個TCP端點,所有來自Unity的ROS通信都通過所述端點路由。

在運動階段,操縱桿指令通過ROS發布,同時實時訂閱來自機器人的視頻流。在操作階段,采用反饋回路通過虛擬現實接口對機械手進行控制。當操作者移動末端執行器的VR表示時,相應的笛卡爾坐標通過ROS傳遞給機械手控制器,命令現實世界的機械手到達新的位置。同時,更新后的關節角度傳回Unity,使其能夠調整機械手的VR模型,以反映物理機器人的運動。界面適用于各種機器人平臺。高斯飛濺過程不受用于數據收集的特定操縱器的影響,使系統適應新的機器人或機械手通常只需要微小的調整,例如修改Unity中的ROS主題名稱和機器人的機載系統,并將新的機械手模型導入Unity場景即可。大多數常用的機器人都有預先存在的URDF模型,并且在遠程操作過程中需要調整的關節角度的數量可以很容易地配置。

機器人向接口發送圖像流,并向其發送位置命令。通過這種方式,人類操作員在通過2D視頻流導航時控制基礎運動。2D視頻投射到虛擬現實中固定位置的屏幕,以最大限度地減少由于操作員的視場縮小而導致的暈動癥。機器人本身使用一個控制器來確保穩定的運動。

為了通用性,無論移動類型如何,都假設可以通過提供笛卡爾速度命令來指揮移動機器人。控制器以(Vx, Vy)的形式從接口接收簡單的速度命令。為了將框架切換到操作階段,框架必須首先生成一個高斯飛濺來放置在VR環境中,如圖3所示。這本身分三個階段完成。首先,機械手移動到一系列預先規劃的位置,以獲得場景的重疊圖像。接下來,圖像用作運動結構(SfM)的輸入來檢測特征,估計camera姿勢,并使用三角測量來計算3D點,然后進行束調整以進行細化。最后,對高斯飛濺本身進行訓練,使用神經渲染生成可用于VR遙操作的3D模型。

場景表示為一組高斯分布,每個分布都有位置、大小、方向和顏色。高斯函數由它們的平均值(在三維空間中的位置)、協方差矩陣(定義它們的形狀和分布)、以及顏色和不透明度等屬性參數化。在渲染過程中,每個高斯投影到二維圖像平面作為一個橢圓的“splat”。splat組合起來形成最終的渲染圖像。

一旦高斯飛濺產生,系統就進入操作階段。這時,啟動了一個反饋回路,其中人類操作員在VR環境中控制機械手的末端執行器的運動。團隊在開發過程中考慮了多種遠程操作控制策略。一系列現有的系統將控制器連接到一個固定在操作員的第一人稱視角內或附近的參考框架。然而,這種方法限制了操作員充分利用VR環境的沉浸式功能的能力,因為它限制了移動和視場。相比之下,團隊提出的框架采用了類似游戲的界面,機器人手臂的3D重建和操作場景直接定位在操作者的面前。操作員可以在VR環境中自由地圍繞這個3D重建進行導航,并通過“抓取”末端致動器并“拖動”它來移動現實世界的機械手來與它進行交互。攝像頭視圖疊加在VR視圖,所以用戶依然可以通過靜態3D重建在遠程操作期間看到現實世界場景的變化。

相關論文:Immersive Teleoperation Framework for Locomanipulation Tasks

https://arxiv.org/pdf/2504.15229

總的來說,團隊為基礎機械手機器人系統引入了一個VR遠程操作框架,并利用高斯飛濺來增強用戶界面的沉浸感,同時保持可用性和可擴展性。研究人員發現,高斯飛濺可以通過僅使用安裝在機械手的RGB攝像頭產生高質量的3D模型,從而顯著提高沉浸感(但這是以增加生成時間為代價)。高斯飛濺的應用補充了所提出的遠程操作界面,并利用機械手和場景的第三人稱視圖增強了框架的沉浸式體驗。未來的研究將包括繞過運動結構來提高3D模型生成的速度,集成動態高斯飛濺,并通過將其適應其他平臺來徹底測試框架的可擴展性。