研究了用于360度視頻流的多任務邊緣用戶通信-計算資源分配

(中國AI網(wǎng) 2025年09月08日)在一項研究中,堪薩斯大學和新澤西理工學院團隊在一個支持邊緣計算的毫米波多用戶虛擬現(xiàn)實系統(tǒng)中,研究了用于360度視頻流的多任務邊緣用戶通信-計算資源分配。為了平衡其中產(chǎn)生的通信與計算權衡,他們構(gòu)建了一個視頻質(zhì)量最大化問題,整合了相互依賴的多任務/多用戶動作空間以及卡頓時間/質(zhì)量變化約束。

研究人員為多任務碼率自適應和計算分配構(gòu)建了一個深度強化學習框架來解決目標問題。所提出解決方案不依賴于關于環(huán)境的先驗知識,僅使用先前的視頻流統(tǒng)計數(shù)據(jù)(例如吞吐量、解碼時間和傳輸延遲)和內(nèi)容信息,在在線觀察流媒體性能的同時調(diào)整分配的視屏碼率和計算分配。

另外,為了捕獲環(huán)境中的任務相互依賴性,利用神經(jīng)網(wǎng)絡級聯(lián)將所提出MTRC方法擴展為兩個新穎的變體,分別稱為R1C2和C1R2。研究人員使用真實的毫米波網(wǎng)絡軌跡和360度視頻數(shù)據(jù)集訓練所有三種方法,以評估它們在期望體驗質(zhì)量、視口峰值信噪比、卡頓時間和質(zhì)量變化方面的性能。結(jié)果表明,所提出方法優(yōu)于最先進的碼率自適應算法,其中C1R2表現(xiàn)最佳,實現(xiàn)了5.21~6.06 dB的PSNR增益、2.18~2.70倍的卡頓時間減少以及4.14~4.50 dB的質(zhì)量變化減少。

可以預見,下一代無線網(wǎng)絡(6G及以后)將促成計算密集型和帶寬饑渴型應用的空前普及,例如(VR/AR。特別是,VR用例在推動社會進步、影響我們的日常生活和經(jīng)濟方面具有巨大潛力。目前,VR應用在教育、培訓、醫(yī)療保健和游戲領域越來越受歡迎,預計2024年全球市場規(guī)模將達到326.4億美元。

新興的VR應用需要流式傳輸高保真度的360度視頻內(nèi)容,而這需要在網(wǎng)絡邊緣附近有充足的通信和計算資源。例如,MPEG建議360度VR至少需要12K的高質(zhì)量空間分辨率和100幀/秒(FPS)的時間速率。另外,與傳統(tǒng)2D視頻流相比,360度視頻流需要計算資源進行編碼、解碼、空間處理、拼接和渲染。例如,360度視頻解碼需要進行球面投影的時空變換。視口自適應流通過基于用戶視場動態(tài)調(diào)整視頻片段,進一步增加了計算復雜度。

而且,與2D視頻相比,360度視頻通常具有更高的分辨率和更大的文件大小,導致更高的帶寬需求。所以,實用的VR架構(gòu)面臨著重大挑戰(zhàn),包括高效的資源管理(計算和通信)、分布式VR用戶之間的協(xié)調(diào)以及提供有保障的QoE。在此背景下,必須滿足幾組不同的要求:(i) 網(wǎng)絡施加的約束,決定了可用的通信鏈路速率;(ii) 計算施加的約束,決定了可用于處理360度視頻的計算資源;(iii) 視頻施加的約束,根據(jù)360度視頻的時空特性而變化;(iv) 用戶施加的約束,決定了用戶在QoE方面的偏好。

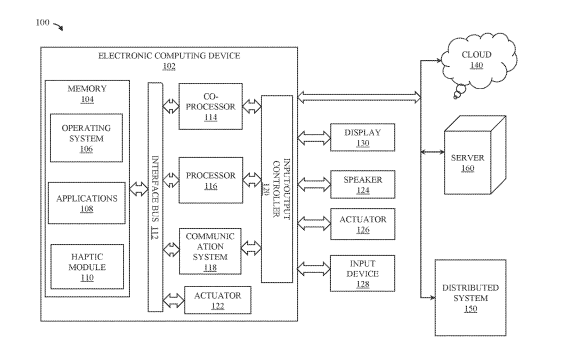

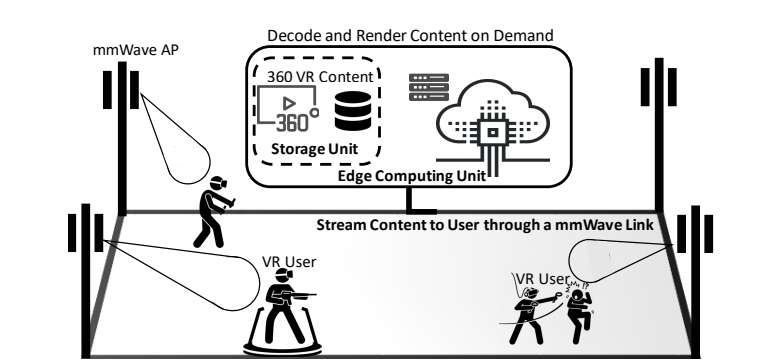

為了應對這些挑戰(zhàn),如圖1所示,堪薩斯大學和新澤西理工學院團隊追求一種新穎的多任務邊緣輔助視頻質(zhì)量最大化框架,用于毫米波網(wǎng)絡中的多用戶360度視頻流。

在這里,360度視頻可以由位于VR場館內(nèi)的邊緣計算單元(ECU)進行解碼和/或渲染。一方面,ECU擁有更多的計算資源,所以可以更快地處理(即解碼/渲染)360度視頻,從而為用戶帶來更低的計算延遲和更高的QoE。另一方面,在ECU進行解碼和渲染為每個用戶引入了更高的帶寬需求,因為處理后的視頻尺寸要大得多,這會導致更高的通信延遲,從而降低QoE。另外,由于時變的網(wǎng)絡條件和360度視頻變化的時空特性,VR系統(tǒng)是一個隨機系統(tǒng)。

研究人員提出的多任務決策框架考慮了移動360度視頻流應用對通信和計算需求的相互作用。利用最先進的深度強化學習方法和多任務神經(jīng)網(wǎng)絡級聯(lián),他們提出了三種DRL智能體架構(gòu),MTRC、C1R2和R1C2。所提出的解決方案解決了一個約束性多任務視頻質(zhì)量最大化問題,整合了用戶性能要求(即卡頓時間和視口質(zhì)量變化)。智能體通過考慮播放統(tǒng)計數(shù)據(jù)(即過去的吞吐量、解碼時間、傳輸時間等)和內(nèi)容信息,學習最優(yōu)碼率分配和計算分配。

團隊的主要貢獻是:

約束性多任務視頻質(zhì)量最大化問題:引入了一種多用戶邊緣輔助VR流方案,其中ECU向VR用戶提供360度視頻。然后,構(gòu)建了一個約束性多任務視頻質(zhì)量最大化問題,以找到相對于用戶性能要求、網(wǎng)絡條件和360度視頻時空特性的最佳碼率自適應和計算分配策略。

多任務碼率自適應與計算分配:他們開發(fā)了一種基于學習的多任務碼率自適應和計算分配框架,其中引入了三種DRL智能體架構(gòu)(即MTRC、R1C2和C1R2),以找到最優(yōu)的碼率自適應和計算分配策略,在滿足用戶性能要求的同時最大化流媒體視頻質(zhì)量。

多用戶360度視頻流模擬器:使用360度視頻率失真特性和用戶頭部移動導航信息的真實世界數(shù)據(jù)集以及毫米波網(wǎng)絡軌跡,開發(fā)了一個360度 VR流模擬器。

利用開發(fā)的模擬器,團隊在各種系統(tǒng)條件下對我們提出的方法進行了廣泛的數(shù)值分析。實驗表明,所提出的解決方案學會了平衡系統(tǒng)中現(xiàn)有的權衡,并優(yōu)于最先進的碼率自適應算法。具體來說,所提出方法實現(xiàn)了5.21~6.06 dB的PSNR增益、2.18~2.70倍的卡頓時間減少和4.14~4.50 dB的質(zhì)量變化減少。

在仿真中,他們使用了一個完整的UHD 360度視頻數(shù)據(jù)集。所述數(shù)據(jù)集包含15個具有不同時空特性的視頻。每個視頻使用第三節(jié)中提出的多層360度模型表示,視頻幀劃分為8×8網(wǎng)格。提供七層的碼率信息,每層為每個圖塊提供逐漸提高的沉浸保真度。另外,包括多個用戶的頭部移動數(shù)據(jù),使得能夠確定每個用戶的視口位置并模擬多用戶VR環(huán)境。同時,使用一個毫米波網(wǎng)絡吞吐量軌跡數(shù)據(jù)集。他們利用數(shù)據(jù)集來訓練上述所有智能體。每個回合中隨機選擇360度視頻和網(wǎng)絡軌跡。

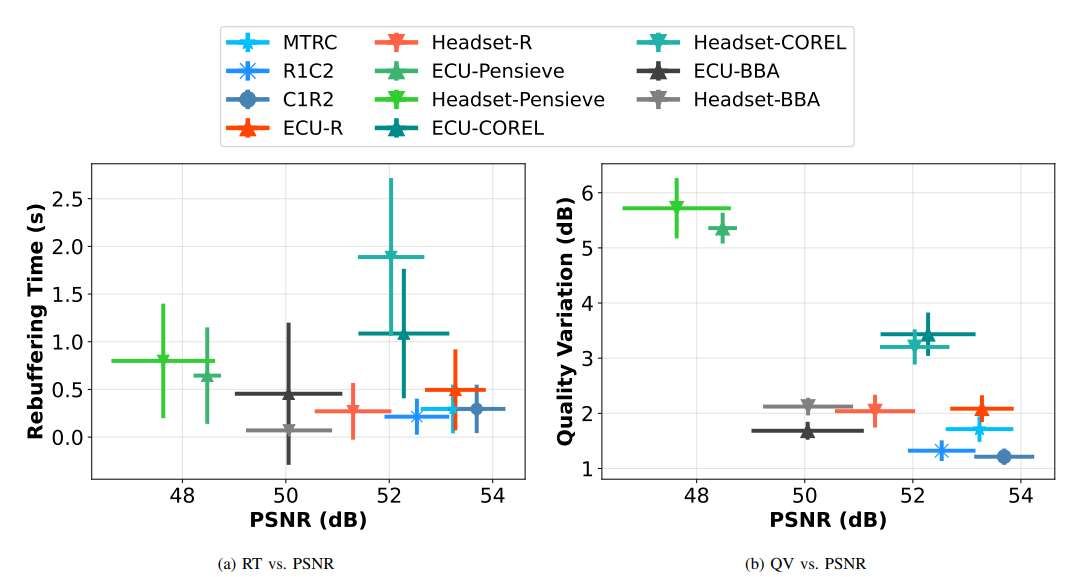

圖6展示了從300次測試回合中收集的卡頓時間、質(zhì)量變化和PSNR之間的性能權衡。每個點表示用戶經(jīng)歷的平均卡頓時間(或質(zhì)量變化)和PSNR。垂直和水平條分別表示卡頓時間(或質(zhì)量變化)和PSNR的標準差。理想情況是卡頓時間(或質(zhì)量變化)小、PSNR高且波動小。

從結(jié)果中,可以觀察到MTRC、R1C2和C1R2智能體提供了最佳的權衡,其中C1R2智能體優(yōu)于所有其他基線方法。具體而言,與ECU-Pensieve和Headset-Pensieve相比,C1R2智能體實現(xiàn)了5.21~6.06 dB的PSNR增益、2.18~2.70倍的卡頓時間減少和4.14~4.50 dB的質(zhì)量變化減少。另外,與ECU-COREL和Headset-COREL相比,C1R2智能體實現(xiàn)了1.41~1.65 dB的PSNR增益、3.67~6.39倍的卡頓時間減少和1.99~2.22 dB的質(zhì)量變化減少。

性能提升主要歸因于兩個原因。首先,智能體可以動態(tài)選擇在何處準備GoP(圖像組)并將計算分配到ECU和頭顯。這相比Pensieve和COREL的變體更好地平衡了通信與計算的權衡。其次,Pensieve和COREL的變體沒有關于準備過程的信息,因此無法捕捉處理時間(即解碼和渲染時間)及其對QoE影響之間的關系。

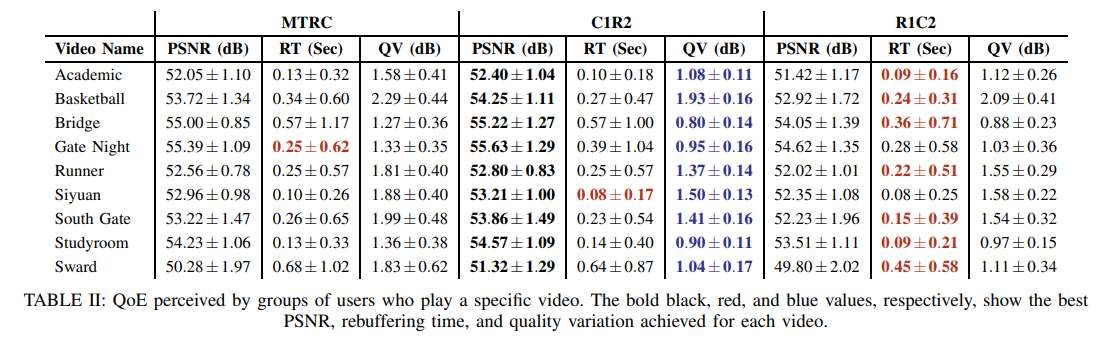

另外,表II報告了播放特定視頻的用戶組的PSNR、卡頓時間和質(zhì)量變化的平均值和標準差。可以看到C1R2為各種時空特性提供了最佳的PSNR和質(zhì)量變化。這是因為碼率自適應智能體可以訪問計算分配動作,這意味著它知道計算是如何在ECU和VR設備之間分配的。因此,它根據(jù)可用的計算資源為用戶分配碼率。然而,R1C2雖然差異不顯著,但為各種時空特性提供了最佳的卡頓時間。這表明R1C2中的計算分配智能體利用碼率分配動作來分配計算,以最小化卡頓時間。

團隊同時通過分析低、中、高吞吐量場景下三組用戶感知到的QoE,展示了無線網(wǎng)絡條件的影響。圖7顯示了這三組的統(tǒng)計特性(即累積分布函數(shù)(CDF)、平均值和標準差)。表III、IV和V中的結(jié)果展示了這三組用戶的PSNR、卡頓時間和質(zhì)量變化的平均值和標準差。

PSNR性能: 在表III中,觀察到C1R2在所有網(wǎng)絡條件下都提供了最佳結(jié)果。另外可以注意到,隨著網(wǎng)絡條件改善(即更高的吞吐量),PSNR會增加。此外,隨著網(wǎng)絡條件變化,C1R2提供的PSNR變化較小(低吞吐量用戶為53.65 dB,而高吞吐量用戶為53.70 dB)。

卡頓時間性能: 在表IV中,可以看到卡頓時間隨著網(wǎng)絡條件的改善而改善。同時,R1C2為所有用戶提供了最佳的卡頓時間。

質(zhì)量變化性能: 如表V所示,雖然C1R2提供了最佳的質(zhì)量變化,但質(zhì)量變化并不隨網(wǎng)絡條件的變化而發(fā)生顯著變化。

流媒體應用的性能通過主觀和客觀測試進行評估。主觀測試用于評估用戶的感知體驗,旨在捕獲用戶的實際流媒體體驗,這取決于多種因素。例如,主觀測試可以提供關于VR體驗的沉浸感和真實感等方面的反饋。另外,主觀測試可以揭示用戶的偏好。然而,主觀測試實施起來更具挑戰(zhàn)性且成本更高,因為它們需要人類參與者,并且提供定性數(shù)據(jù),由于其性質(zhì)和參與者的多樣性,這些數(shù)據(jù)更難量化、分析和復現(xiàn)。

而且,它們?nèi)狈εc流媒體系統(tǒng)設計中優(yōu)化目標的直接且可量化分析的聯(lián)系,因此無法惠及相關研究。為了克服進行主觀測試的挑戰(zhàn),人們提出了客觀指標,如均方誤差(MSE)和PSNR,用于衡量視頻應用的流媒體/編碼算法的質(zhì)量。MSE和PSNR被廣泛使用有諸多原因:它們易于計算、具有明確的物理意義,并且在數(shù)學上便于優(yōu)化。然而,MSE和PSNR無法捕獲視覺質(zhì)量的某些方面。

所以,研究人員中提出了其他指標,將視覺質(zhì)量的其他方面和主觀測量納入考慮。結(jié)構(gòu)相似性指數(shù)(SSIM)通過將圖像退化視為結(jié)構(gòu)信息、亮度和對比度的感知變化來整合圖像的視覺質(zhì)量。另外,Netflix通過引入視頻多方法評估融合(VMAF)指標,將更多主觀測量納入考慮。VMAF采用機器學習模型將各種視頻特征(例如,空間質(zhì)量、時間質(zhì)量和準確色彩再現(xiàn)的保持)組合成一個單一的質(zhì)量分數(shù)。模型在主觀視頻質(zhì)量數(shù)據(jù)集上訓練,其中人類觀看者對視頻的感知質(zhì)量進行了評分。因此,VMAF能夠整合各種感知方面,同時提供一個客觀指標來評估流媒體/編碼方法的性能。

在此背景下,表VI報告了環(huán)境中一部分用戶的SSIM、VMAF、MSE和PSNR的平均值和標準差。SSIM列顯示不同基線方法之間的SSIM差異很小。這種微小差異表明所有方法在保持視頻內(nèi)容的結(jié)構(gòu)完整性方面都是有效的,這表明盡管在VMAF、MSE和PSNR等整體質(zhì)量指標上存在差異,但核心視覺結(jié)構(gòu)在這些技術之間基本保持一致。

值得注意的是,C1R2在VMAF(95.60±1.96)和MSE(0.22±0.14)方面取得了最高分,表明其保持視頻質(zhì)量和最小化失真的能力。雖然MTRC和R1C2與C1R2方法相比略有不足,但它們始終優(yōu)于Pensieve、COREL和BBA變體。例如,基于Pensieve的方法(如ECU-Pensieve和Headset-Pensieve)顯示出較低的PSNR和VMAF值,以及顯著較高的MSE,突顯了它們在保持一致視頻質(zhì)量方面的局限性。相比之下,團隊提出的方法,特別是C1R2,提供了強大而穩(wěn)定的性能,證明了它們在提供高質(zhì)量視頻體驗方面的有效性。這一比較凸顯了所提出方法在優(yōu)化視覺質(zhì)量和抵抗失真方面的效率,使其更適合需要高精度和可靠性的應用。

相關論文:Neural-Enhanced Rate Adaptation and Computation Distribution for Emerging mmWave Multi-User 3D Video Streaming Systems

https://arxiv.org/pdf/2505.13337

總的來說,團隊研究了360度視頻流平臺VR環(huán)境中的多任務碼率自適應和計算分配問題。他們提出了一種基于學習的多任務智能體,其中智能體決定分配給每個用戶的視頻碼率以及計算分配。總體目標是在視頻請求、可用計算資源、通信帶寬和用戶要求方面的動態(tài)和時變條件下最大化用戶的視頻質(zhì)量。

利用最先進的DRL算法,研究人員開發(fā)了MTRC,它利用播放統(tǒng)計數(shù)據(jù)和視頻信息來做出聯(lián)合碼率自適應和計算分配決策。另外,利用神經(jīng)網(wǎng)絡級聯(lián)擴展了MTRC,并引入了R1C2和C1R2方法。R1C2和C1R2通過考慮碼率自適應動作和計算分配動作之間的相互依賴性,進一步提高了VR用戶的QoE。通過使用真實網(wǎng)絡軌跡和360度視頻信息的數(shù)值模擬,實驗表明所提出的方法學會了平衡系統(tǒng)中現(xiàn)有的權衡,并優(yōu)于最先進的碼率自適應算法。具體而言,C1R2智能體表現(xiàn)出最佳性能,實現(xiàn)了5.21~6.06 dB的PSNR增益、2.18~2.70倍的卡頓時間減少和4.14~4.50 dB的質(zhì)量變化減少。