查看引用/信息源請點擊:techxplore

從模糊的單目視頻中重建清晰4D場景并實現新視角合成,同時無需掩模監督

(中國AI網 2025年09月23日)神經輻射場(NeRF)是一項令人著迷的技術,它能夠從不同角度拍攝的一組2D圖像中創建場景的3D表征。所述技術通過訓練深度神經網絡來預測三維空間中任意點的顏色和密度實現這一目標。

具體而言,NeRF通過從攝像頭投射虛擬光線穿透所有輸入圖像的每個像素,沿著光線采集具有3D坐標和觀察方向的采樣點。利用相關信息,NeRF即可重建3D場景,并能從全新視角進行渲染,這一過程稱為新視角合成(NVS)。

除了靜態圖像,這項技術同樣可應用于視頻,將視頻的每一幀視為靜態圖像進行處理。但現有方法對視頻質量高度敏感,不可避免地會因對象快速移動或攝像頭抖動而產生運動模糊,導致難以生成清晰的動態新視角合成畫面。這是因為現有基于去模糊的NVS方法多針對靜態多視角圖像設計,無法有效處理全局相機運動和局部物體運動。另外,模糊視頻往往會導致camera位姿估計失準和幾何精度損失。

為解決這個問題,韓國中央大學團隊聯合開發了MoBluRF:一種針對NeRF的雙階段運動去模糊方法。研究人員表示,這項技術可以幫助減少虛擬現實和增強現實中對專業拍攝組件的需求。

團隊解釋道:“我們的框架通過運動分解技術,能夠從模糊的單目視頻中重建清晰4D場景并實現新視角合成,同時無需掩模監督,顯著推進了NeRF領域發展。”

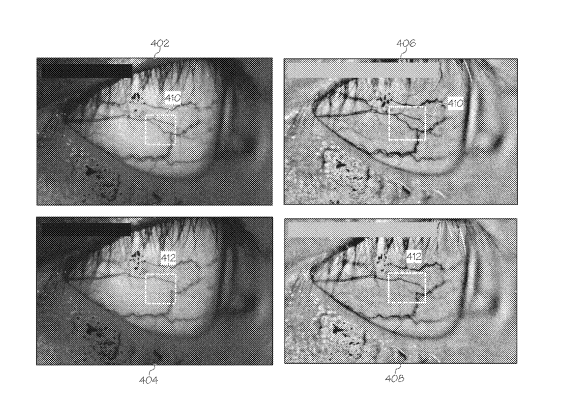

MoBluRF包含兩個核心階段:基礎光線初始化(BRI)和基于運動分解的去模糊(MDD)。現有基于去模糊的NVS方法試圖通過變換稱為基礎光線的射線來預測模糊圖像中隱藏的清晰光線(潛在銳利射線)。但直接將模糊圖像中的輸入射線用作基礎射線會導致預測失準。BRI階段通過從模糊視頻中粗略重建動態3D場景,并優化來自不精確攝像頭射線的基礎射線初始化來解決這一問題。

在MDD階段,基礎射線通過增量潛在銳利射線預測(ILSP)方法精準預測潛在銳利射線。ILSP將運動模糊逐步分解為全局攝像頭運動和局部物體運動分量,極大提升了去模糊精度。MoBluRF同時引入了兩種新穎的損失函數:一種無需運動掩模即可分離靜態與動態區域,另一種能提升動態物體的幾何精度,而這兩個領域正是以往方法的薄弱環節。

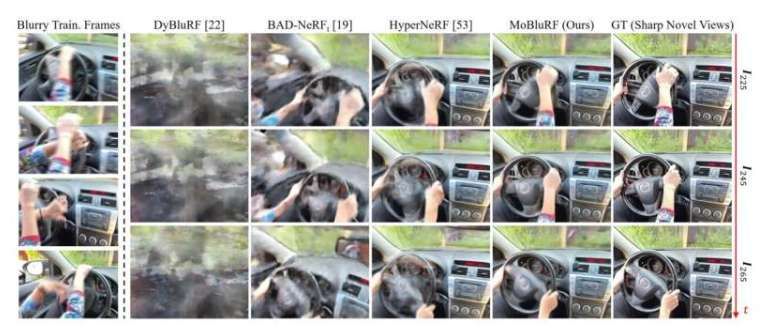

憑借創新設計,MoBluRF在多類數據集上以顯著優勢在定量和定性方面超越現有先進方法,并對不同程度模糊具有魯棒性。團隊指出:“這項技術可以減少虛擬現實和增強現實中對專業拍攝組件的需求。”

相關論文:MoBluRF: Motion Deblurring Neural Radiance Fields for Blurry Monocular Video

https://ieeexplore.ieee.org/document/11017407

MoBluRF為NeRF技術開辟了新方向,使得通過日常設備拍攝的普通模糊視頻實現高質量3D重建成為可能。