查看引用/信息源請點擊:中國AI網

六自由度導航數據集

(中國AI網 2025年09月26日)3DGS是一種新興的媒體表示技術,能夠高保真地重建真實世界的3D場景,并支持在虛擬現實中進行六自由度導航。然而,開發(fā)和評估支持3DGS的應用程序以及優(yōu)化其渲染性能,都需要真實的用戶導航數據。目前,對于真實世界場景的光線級真實感3DGS重建,這類數據尚不可用。

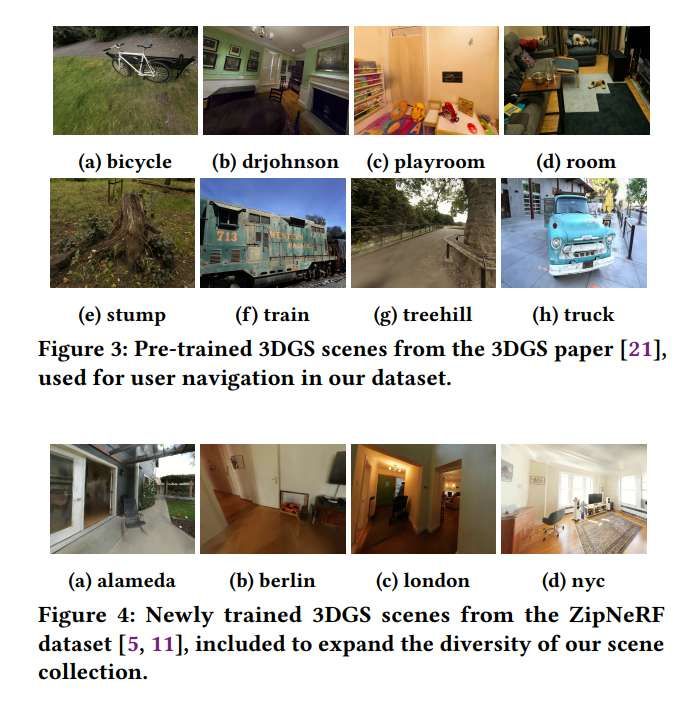

所以,美國羅格斯大學和臺灣清華大學團隊介紹了EyeNavGS,這是首個公開可用的六自由度導航數據集,包含46名參與者探索十二個多樣化真實世界3DGS場景的軌跡。數據集在兩個地點收集,使用Meta Quest Pro頭顯,記錄了在自由導航期間每個渲染幀的頭部姿態(tài)和眼動注視數據。對于十二個場景中的每一個,研究人員都進行了細致的場景初始化以校正場景傾斜和尺度,確保感知舒適的VR體驗。

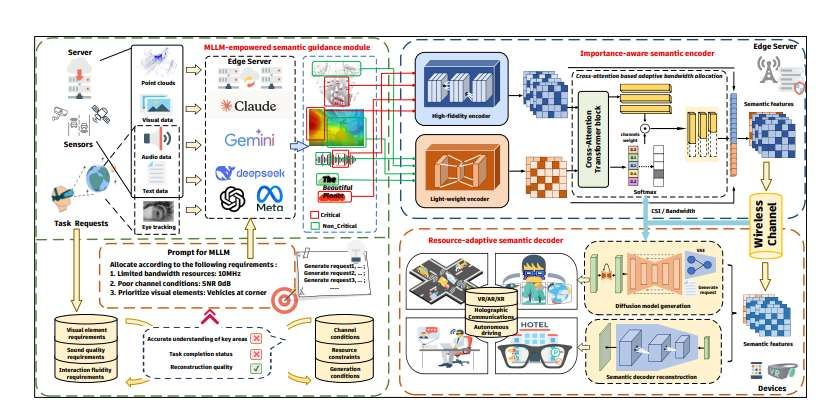

團隊同時發(fā)布了開源的SIBR查看器軟件分支,提供記錄和回放功能,以及一套用于數據處理、轉換和可視化的實用工具。EyeNavGS數據集及其附帶的軟件工具為推進六自由度視口預測、自適應流傳輸、3D顯著性以及3DGS場景的注視點渲染等方面的研究提供了寶貴資源。

自2023年推出以來,3DGS迅速成為一種用于3D場景表示的流行沉浸式媒體格式,支持對復雜真實世界環(huán)境進行高保真、六自由度的探索。由于其快速的訓練時間和實時渲染速度,它受到了學術界和工業(yè)界的廣泛關注。3DGS解鎖了新的可能性,包括在支持WebGL的移動設備進行渲染,并將傳統的視頻流傳輸范式擴展到完整的六自由度體三維內容。

例如,SGSS和L3GS提出了針對靜態(tài)3DGS場景的流傳輸方法。LapisGS 引入了一種分層3DGS表示,支持漸進式自適應流傳輸。在LapisGS的基礎上,LTS提出了動態(tài)3DGS場景的自適應流傳輸方法。然而,缺乏合適的數據集阻礙了支持3DGS的系統和應用的發(fā)展與評估。為了在真實條件下正確評估自適應流傳輸算法的系統性能、渲染優(yōu)化、壓縮策略和體驗質量,記錄用戶與六自由度場景真實交互的大規(guī)模數據集至關重要。

然而,目前沒有什么可用的數據集。缺乏這類數據集迫使研究人員依賴合成軌跡或從不同3D表示收集的數據集,而它們可能無法忠實代表用戶與高保真3DGS內容的交互。為了彌補這一空白,美國羅格斯大學和臺灣清華大學團隊介紹了EyeNavGS,一個公開可用的用戶導航軌跡數據集。它包含穿越十二個場景的軌跡,涵蓋室內和室外環(huán)境,并為研究虛擬現實中的用戶導航行為以及性能-質量權衡提供了多樣化的視覺特性。

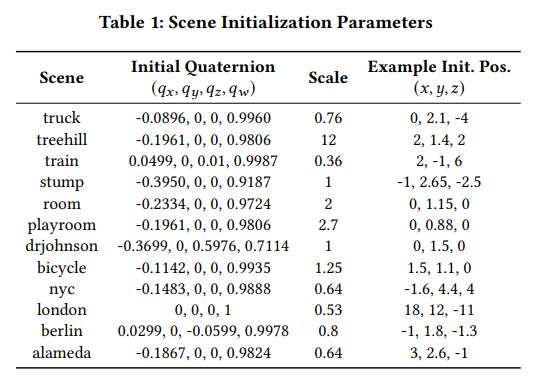

為了準備每個訓練好的3DGS場景以進行沉浸式探索,團隊校正每個原始場景以符合人類對物理世界的假設。校正包括:i) 校正初始四元數以修復場景傾斜,ii) 選擇每個場景的比例因子以確保物體與其真實世界比例匹配,以及 iii) 建立示例起始觀看位置。每個場景的值如表1所示。

場景傾斜和方向校正: 3DGS場景是從COLMAP生成的初始點云訓練而來的。然而,COLMAP重建的坐標系本身并非重力對齊的。方向不正確的場景經常導致令人迷失方向的傾斜、不自然的坡度、扭曲的camera行為,從而降低虛擬環(huán)境中的臨場感和空間連貫性。

為了在VR中創(chuàng)造感知舒適的體驗,必須首先將虛擬場景與重力對齊。所提出的解決方案不是修改每個場景訓練好的3DGS .ply文件,而是在加載每個場景時應用校正變換。為了找到場景的傾斜量,使用Blender和支持3DGS點數據的KIRI Engine插件實現一個穩(wěn)健的程序。在Blender中,插入了一個垂直于Y軸(與重力對齊)的參考平面,并手動調整場景的方向,確保其地平面與虛擬Y軸正交并與參考平面匹配。這個過程有效地糾正了任何殘余傾斜,確保用戶感知到的場景是接地和穩(wěn)定的,避免了處于斜坡上的感知錯覺。旋轉參數隨后導出為四元數,并在VR渲染期間于運行時應用,以確保與用戶物理“舞臺”區(qū)域的正確對齊。

場景尺度校準: 原始訓練好的3DGS場景的另一個關鍵限制是缺乏固有的真實世界尺度——這同樣歸因于COLMAP。在VR頭顯中進行立體渲染時,場景單位與物理世界單位之間缺乏校準會嚴重扭曲感知到的物體大小。例如,比例過小的場景會導致用戶感覺異常巨大,像巨人一樣。這是因為物理瞳距IPD相對于虛擬世界的尺度被有效地放大。

由于VR渲染本質上依賴于精確模擬用戶雙眼之間的雙目視差,所以校準場景尺度對于保持沉浸感和視覺舒適度至關重要。與場景傾斜校正類似,避免直接修改訓練好的3DGS .ply文件。相反,在運行時應用每個場景的比例因子,將真實世界公制測量的運動映射到場景的虛擬單位。

研究人員在每個場景中引入了尺寸精確的參考對象,例如一個1米立方體。通過比較真實場景中的已知尺寸(例如,車輛的寬度、樓梯的踏步高度)與其3DGS表示,團隊在Blender的單位系統中迭代調整了場景比例。校準后的比例因子記錄下來并在運行時應用,確保感知到的虛擬場景符合真實世界比例,并支持感知正確的立體視覺IPD渲染。

除了傾斜和尺度,初始視圖位置同樣會影響用戶的第一印象和后續(xù)探索。3DGS場景的默認原點([0, 0, 0])通常對應于捕獲體積的中心,這可能導致不理想的起始視點,例如在樹或墻內,或漂浮在空中。為了改善用戶體驗,為每個場景手動選擇了語義上有意義且物理上合理的初始camera位置——通常是地板高度且周圍有充足可導航空間的區(qū)域。選擇相關位置是為了模擬自然的人類視角,促進直觀的探索,并避免遮擋或碰撞。

研究人員擴展了SIBR核心渲染引擎,增加了專為OpenXR中3DGS定制的記錄和回放功能。

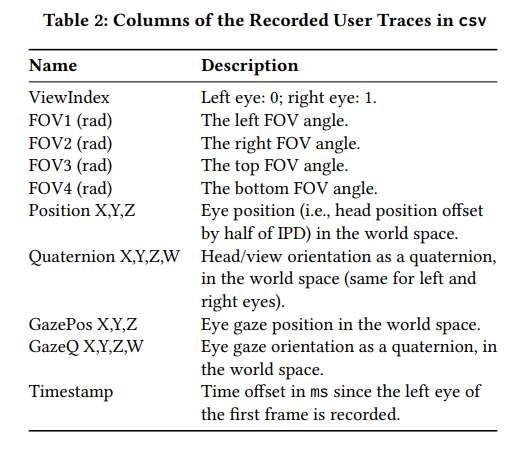

記錄模式: 在記錄模式下,修改后的OpenXR模塊在用戶的VR會話期間捕獲細粒度的、每幀數據。對于每個渲染幀和每只眼睛(左和右),記錄一組全面的參數:視場、眼睛位置、頭部方向(作為四元數),以及眼睛注視位置和注視方向四元數。數據與渲染循環(huán)同步,并保存到具有精確時間戳的結構化csv文件中。這使得能夠完整準確地離線重建用戶的視點。

回放模式: 回放模式利用記錄的軌跡來復現原始的VR會話,用于分析和渲染視圖生成。在回放期間,解析記錄的軌跡,并將記錄的數據逐行注入渲染管線,覆蓋頭顯姿態(tài)信息。回放模式生成兩個獨立的視頻,每只眼睛一個,精確復現了原始的立體體驗。

表2概述了記錄的csv軌跡的結構。為了支持立體視圖,每個渲染幀包含左眼和右眼的渲染視圖,通過“ViewIndex”列區(qū)分(0表示左眼,1表示右眼)。每只眼睛的FOV由FOV1、FOV2、FOV3和FOV4捕獲,分別代表其左、右、上、下邊界(以弧度表示)。由于IPD,左眼和右眼在世界坐標系中看到不同的視圖。因此,表示視圖/頭部位置的Pos_X、Pos_Y、Pos_Z對于左眼和右眼是不同的。

另一方面,在世界空間中跟蹤的頭部方向的四元數由Quat_X、Quat_Y、Quat_Z和Quat_W給出,這對于左眼和右眼是相同的。如果頭顯支持(例如Meta Quest Pro),記錄的軌跡將包含用戶注視信息。這里,GazePos_X、GazePos_Y、GazePos_Z表示世界空間中的眼睛注視位置。它們與相應的眼睛位置Pos_X、Pos_Y、Pos_Z非常相似但又不同。

GazeQ_X、GazeQ_Y、GazeQ_Z和GazeQ_W以四元數形式提供世界空間中的眼睛注視方向。由于眼球在眼窩內的運動,這些列可能與頭部方向有顯著差異。最后,為每個記錄的幀記錄以毫秒為單位的相對時間戳。表3給出了兩個渲染幀的示例列。可以注意到,每兩個連續(xù)的行對應于每個渲染幀的左眼和右眼視圖。

EyeNavGS數據集具有詳細的六自由度導航軌跡(包括頭部姿態(tài)和眼動注視信息),為沉浸式計算系統研究提供了寶貴的機會。EyeNavGS數據集填補了現有數據集所缺乏的、針對重建的真實世界場景的6-DoF用戶導航軌跡的空白。VR中重建的真實世界場景的細粒度頭部姿態(tài)和眼球注視可用于開發(fā)六自由度視口預測算法。這種預測可以為自適應媒體流傳輸算法的設計提供信息,使其僅獲取渲染用戶視口所需的內容,而不會在表示的未觀看部分浪費帶寬。

EyeNavGS數據集中豐富的每幀眼球注視信息也為3D顯著性研究提供了機會。詳細的注視數據可以跨參與者聚合,以創(chuàng)建3DGS場景的真實3D顯著性圖。這些圖隨后可用于訓練3D顯著性模型,以更好地預測用戶在看重建的真實世界場景時會注視哪里。另外,由于重建的3DGS場景可能包含缺陷,如構建不足的區(qū)域和其他視覺偽影,數據集同時能夠研究這些缺陷如何影響用戶注視和導航行為。

注視點渲染是VR中的一項重要技術,旨在降低渲染計算需求并提高幀速率。鑒于人類視覺的敏銳度在遠離中央凹中心時急劇下降,注視點渲染通過降低用戶視圖外圍(非中央凹)區(qū)域的著色率來工作。這可以在對視覺質量影響最小的情況下實現顯著的性能提升。現有研究已經探索了將注視點渲染應用于3DGS渲染,例如MetaSapiens和VR-Splatting。EyeNavGS數據集包含了在3DGS場景的自由站立六自由度導航期間收集的每幀眼睛注視軌跡,有助于評估和優(yōu)化這些注視點渲染技術的實際性能。

相關論文:EyeNavGS: A 6-DoF Navigation Dataset and Record-n-Replay Software for Real-World 3DGS Scenes in VR

https://arxiv.org/pdf/2506.02380

總的來說,EyeNavGS是一個基于真實世界場景的光線級真實感3DGS重建的公開可用六自由度導航數據集,同時提供了一個具有記錄回放功能的SIBR查看器開源軟件分支。EyeNavGS專注于捕獲詳細且真實的行為。它通過收集用戶在真實世界環(huán)境場景中的軌跡來實現這一點,而場景經過仔細校準(傾斜、尺度和起始視點)以保持真實感。

數據集捕獲了立體姿態(tài)、視場角和眼動追蹤軌跡。另外,多站點數據收集(兩個機構的46名參與者)確保了參與者群體的多樣性。EyeNavGS的真實性、細節(jié)和多樣性為沉浸式媒體研究人員填補了一個關鍵空白,允許在流傳輸、渲染和壓縮等核心領域進行以用戶為中心的評估。

更多關于數據集的信息請訪問這個頁面。