HourVideo是斯坦福大學李飛飛和吳佳俊團隊推出的長視頻理解基準數據集,包含500個第一人稱視角視頻,時長20至120分鐘,覆蓋77種日常活動,能評估多模態模型對長視頻的理解能力。數據集基于一系列任務,如總結、感知、視覺推理和導航,測試模型對視頻中多個時間片段信息的識別和綜合能力,推動長視頻理解技術的發展。

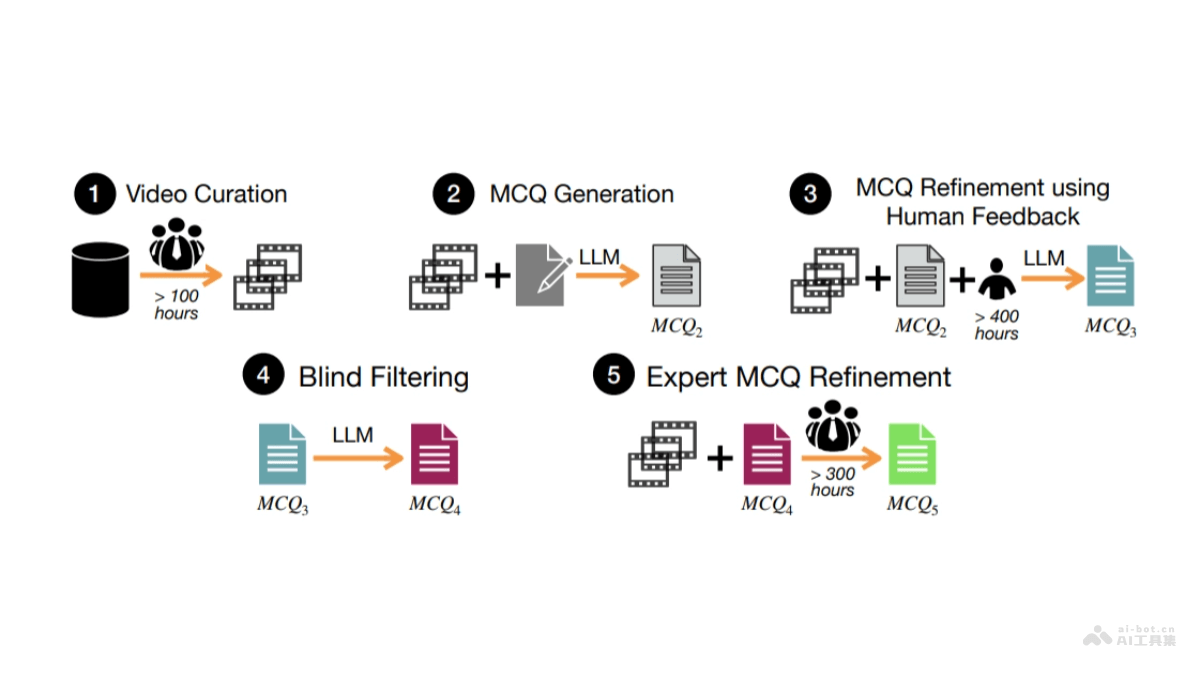

HourVideo的主要功能長視頻理解評估:基于包含長達一小時的視頻,HourVideo能測試模型對長時間視覺數據流的理解能力。多任務測試套件:數據集包含多種任務,如總結、感知、視覺推理和導航,全面評估模型在不同視頻語言理解方面的表現。高質量問題生成:基于人工注釋者和大型語言模型(LLMs)生成的12,976個多項選擇題,提供標準化的測試題目。模型性能比較:與其他多模態模型的比較,評估不同模型在長視頻理解任務上的性能。HourVideo的技術原理視頻數據集構建:HourVideo從Ego4D數據集中篩選出500個第一人稱視角視頻,覆蓋日常活動,視頻時長從20到120分鐘不等。任務套件設計:設計一套包含多個子任務的任務套件,每個任務需要模型對視頻內容進行長期依賴關系的理解和推理。問題原型開發:為每個任務設計問題原型,確保正確回答問題需要對視頻的多個時間片段進行信息識別和綜合。數據生成流程:基于一個多階段的數據生成流程,包括視頻篩選、問題生成、人工反饋優化、盲篩選和專家優化,生成高質量的多項選擇題。HourVideo的項目地址arXiv技術論文:https://arxiv.org/pdf/2411.04998v1HourVideo的應用場景多模態人工智能研究:研究和開發理解長時間連續視頻內容的多模態模型。自主代理和助手系統:幫助開發理解長時間視覺信息并做出決策的自主代理和虛擬助手。增強現實(AR)和虛擬現實(VR):提供技術基礎,創建能理解和適應用戶行為的沉浸式AR/VR體驗。視頻內容分析:分析和理解視頻內容,如監控視頻、新聞報道、教育視頻等,提取關鍵信息和洞察。機器人視覺:讓機器人能理解長時間序列的視覺信息,提高其在復雜環境中的導航和操作能力。

HourVideo的主要功能長視頻理解評估:基于包含長達一小時的視頻,HourVideo能測試模型對長時間視覺數據流的理解能力。多任務測試套件:數據集包含多種任務,如總結、感知、視覺推理和導航,全面評估模型在不同視頻語言理解方面的表現。高質量問題生成:基于人工注釋者和大型語言模型(LLMs)生成的12,976個多項選擇題,提供標準化的測試題目。模型性能比較:與其他多模態模型的比較,評估不同模型在長視頻理解任務上的性能。HourVideo的技術原理視頻數據集構建:HourVideo從Ego4D數據集中篩選出500個第一人稱視角視頻,覆蓋日常活動,視頻時長從20到120分鐘不等。任務套件設計:設計一套包含多個子任務的任務套件,每個任務需要模型對視頻內容進行長期依賴關系的理解和推理。問題原型開發:為每個任務設計問題原型,確保正確回答問題需要對視頻的多個時間片段進行信息識別和綜合。數據生成流程:基于一個多階段的數據生成流程,包括視頻篩選、問題生成、人工反饋優化、盲篩選和專家優化,生成高質量的多項選擇題。HourVideo的項目地址arXiv技術論文:https://arxiv.org/pdf/2411.04998v1HourVideo的應用場景多模態人工智能研究:研究和開發理解長時間連續視頻內容的多模態模型。自主代理和助手系統:幫助開發理解長時間視覺信息并做出決策的自主代理和虛擬助手。增強現實(AR)和虛擬現實(VR):提供技術基礎,創建能理解和適應用戶行為的沉浸式AR/VR體驗。視頻內容分析:分析和理解視頻內容,如監控視頻、新聞報道、教育視頻等,提取關鍵信息和洞察。機器人視覺:讓機器人能理解長時間序列的視覺信息,提高其在復雜環境中的導航和操作能力。