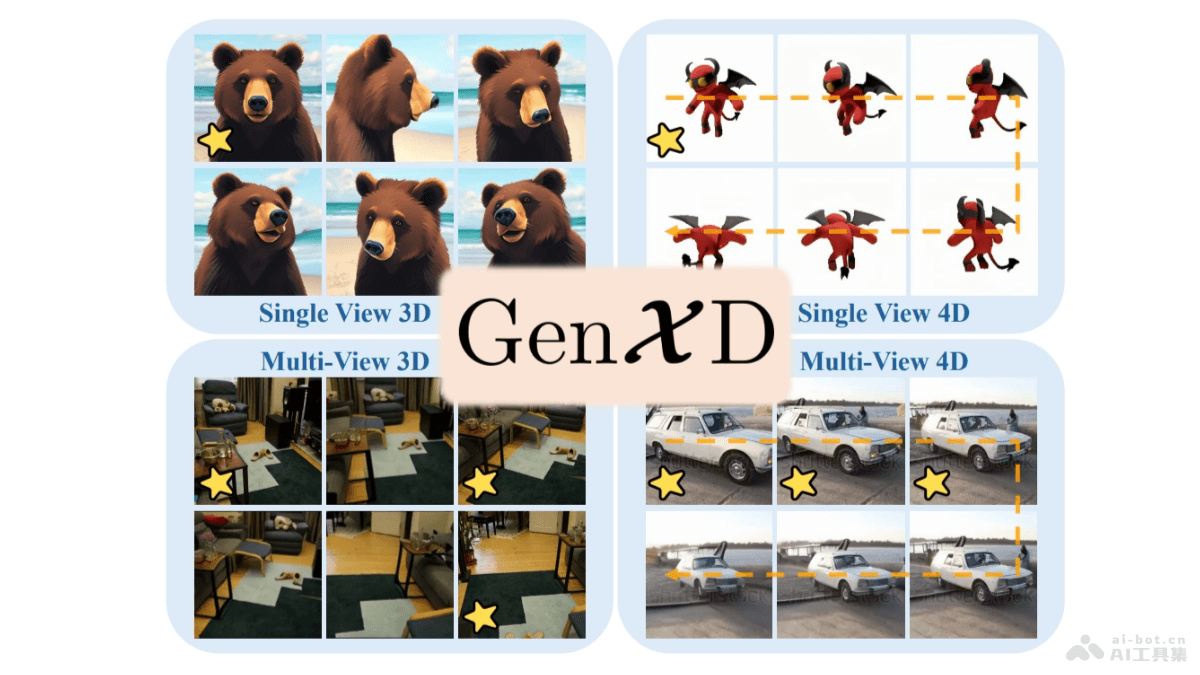

GenXD是新加坡國立大學和微軟公司共同推出的3D-4D聯合生成框架,能從任意數量的條件圖像中生成高質量的3D和4D場景。框架用一個數據整理流程從視頻中提取相機姿態和物體運動強度,基于這些信息及大規模4D數據集CamVid-30K訓練模型。GenXD基于多視角時序模塊解耦相機和物體的運動,用掩碼潛在條件支持多種視角的條件生成,實現在單一模型中處理多種3D和4D生成任務。

GenXD的主要功能3D和4D場景生成:GenXD能從單視圖或多視圖中生成高質量的3D和4D場景,包括動態和靜態內容。相機姿態估計:基于結構從運動(SfM)技術,GenXD估計視頻中的相機姿態,為生成與相機軌跡一致的視頻提供基礎。物體運動估計:基于深度估計和關鍵點跟蹤,GenXD識別和模擬視頻中物體的運動。多視角時序模塊:框架內部的模塊處理多視角和時間信息,解耦相機運動和物體運動,生成更加真實的動態場景。掩碼潛在條件:GenXD支持用掩碼潛在條件進行條件生成,支持模型在不改變網絡結構的情況下接受任意數量的輸入視圖。GenXD的技術原理數據整理流程:GenXD基于一個數據整理流程從視頻中提取相機姿態和物體運動信息,為后續的模型訓練提供必要的數據。多視角時序模塊:GenXD內部的多視角時序模塊能夠處理多視角和時間信息,用α融合策略在3D和4D數據中進行無縫學習。掩碼潛在條件擴散模型:GenXD用掩碼潛在條件擴散模型(LDM)生成不同相機視角和時間步長的圖像,支持單視圖和多視圖生成。解耦相機和物體運動:基于多視角時序模塊,GenXD分離相機運動和物體運動,對生成動態場景至關重要。3D和4D數據融合:GenXD在訓練過程中結合3D和4D數據,讓模型同時學習空間和時間信息,提高生成質量。3D表示優化:GenXD生成的圖像直接用于優化3D表示,如3D高斯點云(3D-GS)和Zip-NeRF,實現高質量的3D場景重建。GenXD的項目地址項目官網:gen-x-d.github.ioGitHub倉庫:https://github.com/HeliosZhao/GenXDarXiv技術論文:https://arxiv.org/pdf/2411.02319GenXD的應用場景視頻游戲開發:GenXD用于生成游戲中的3D和4D環境,提供更加真實和動態的游戲世界。電影和視覺效果:在電影制作中,GenXD創建復雜的3D場景和特效,減少實際拍攝和后期制作的成本。虛擬現實(VR)和增強現實(AR):GenXD生成沉浸式的3D和4D內容,提升VR和AR應用的用戶體驗。建筑和城市規劃:基于GenXD生成的3D模型,建筑師和城市規劃者更直觀地展示設計概念和規劃方案。教育和培訓:GenXD創建模擬環境,用在教育和專業培訓,如模擬手術、歷史重現等。

GenXD的主要功能3D和4D場景生成:GenXD能從單視圖或多視圖中生成高質量的3D和4D場景,包括動態和靜態內容。相機姿態估計:基于結構從運動(SfM)技術,GenXD估計視頻中的相機姿態,為生成與相機軌跡一致的視頻提供基礎。物體運動估計:基于深度估計和關鍵點跟蹤,GenXD識別和模擬視頻中物體的運動。多視角時序模塊:框架內部的模塊處理多視角和時間信息,解耦相機運動和物體運動,生成更加真實的動態場景。掩碼潛在條件:GenXD支持用掩碼潛在條件進行條件生成,支持模型在不改變網絡結構的情況下接受任意數量的輸入視圖。GenXD的技術原理數據整理流程:GenXD基于一個數據整理流程從視頻中提取相機姿態和物體運動信息,為后續的模型訓練提供必要的數據。多視角時序模塊:GenXD內部的多視角時序模塊能夠處理多視角和時間信息,用α融合策略在3D和4D數據中進行無縫學習。掩碼潛在條件擴散模型:GenXD用掩碼潛在條件擴散模型(LDM)生成不同相機視角和時間步長的圖像,支持單視圖和多視圖生成。解耦相機和物體運動:基于多視角時序模塊,GenXD分離相機運動和物體運動,對生成動態場景至關重要。3D和4D數據融合:GenXD在訓練過程中結合3D和4D數據,讓模型同時學習空間和時間信息,提高生成質量。3D表示優化:GenXD生成的圖像直接用于優化3D表示,如3D高斯點云(3D-GS)和Zip-NeRF,實現高質量的3D場景重建。GenXD的項目地址項目官網:gen-x-d.github.ioGitHub倉庫:https://github.com/HeliosZhao/GenXDarXiv技術論文:https://arxiv.org/pdf/2411.02319GenXD的應用場景視頻游戲開發:GenXD用于生成游戲中的3D和4D環境,提供更加真實和動態的游戲世界。電影和視覺效果:在電影制作中,GenXD創建復雜的3D場景和特效,減少實際拍攝和后期制作的成本。虛擬現實(VR)和增強現實(AR):GenXD生成沉浸式的3D和4D內容,提升VR和AR應用的用戶體驗。建筑和城市規劃:基于GenXD生成的3D模型,建筑師和城市規劃者更直觀地展示設計概念和規劃方案。教育和培訓:GenXD創建模擬環境,用在教育和專業培訓,如模擬手術、歷史重現等。