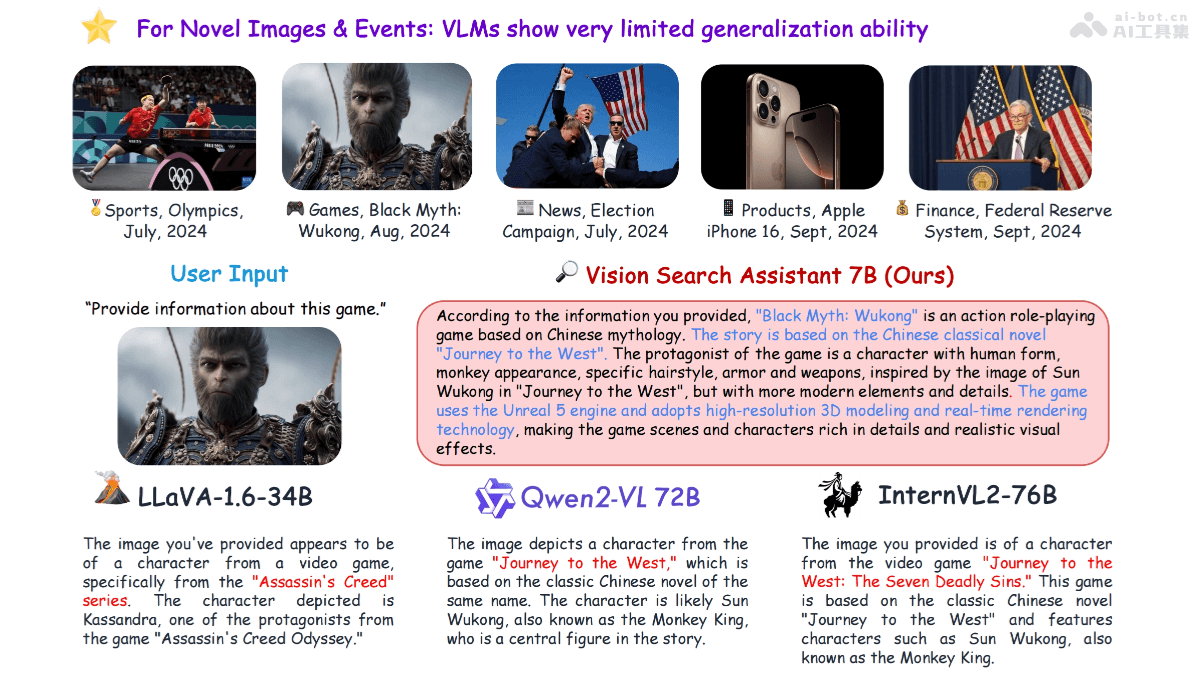

Vision Search Assistant(VSA)是結合視覺語言模型(VLMs)和網絡代理的框架,提升模型對未知視覺內容的理解能力。基于互聯網檢索,使VLMs處理和回答有關未見圖像的問題。VSA在開放集和封閉集問答測試中表現出色,顯著優于包括LLaVA-1.6-34B、Qwen2-VL-72B和InternVL2-76B在內的其他模型。Vision Search Assistant能廣泛應用于現有VLMs,增強處理新圖像和事件的能力。

Vision Search Assistant的主要功能視覺內容表述:識別圖像中的關鍵對象、生成描述,考慮對象之間的相關性,這一過程稱為相關表述(Correlated Formulation)。網絡知識搜索:基于一個名為“Chain of Search”的迭代算法,生成多個子問題,用網絡代理搜索相關信息,獲取與用戶問題和圖像內容相關的網絡知識。協作生成:結合原始圖像、用戶的問題、相關表述及通過網絡搜索獲得的知識,用VLM生成最終的答案。多模態搜索引擎:將任意VLM轉變為能理解和響應視覺內容的多模態自動搜索引擎。實時信息訪問:用網絡代理的實時信息訪問能力,讓VLM獲取最新的網絡數據,提高回答的準確性。開放世界檢索增強生成:基于互聯網檢索,擴展VLMs處理新視覺內容的能力,讓其能夠處理和回答有關未見過的圖像或新概念的問題。Vision Search Assistant的技術原理視覺內容識別與描述:用VLM對輸入圖像進行分析,識別出圖像中的關鍵對象,生成描述對象的文本。相關性分析:生成單個對象的描述,分析對象之間的相關性,生成一個綜合考慮這些關系的文本表示,即相關表述。子問題生成:基于用戶的問題和相關表述,VSA用大型語言模型(LLM)生成一系列子問題,子問題引導搜索過程,找到更具體的信息。網絡搜索與知識整合:基于網絡代理執行子問題搜索,分析搜索引擎返回的網頁,提取、總結相關信息,形成網絡知識。迭代搜索過程:用“Chain of Search”算法,基于迭代過程逐步細化搜索,獲得更豐富、更準確的網絡知識。Vision Search Assistant的項目地址項目官網:cnzzx.github.io/VSAGitHub倉庫:https://github.com/cnzzx/VSAarXiv技術論文:https://arxiv.org/pdf/2410.21220Vision Search Assistant的應用場景圖像識別與搜索:用戶上傳一張圖片,識別圖片中的內容并提供相關信息,例如識別歷史人物、地標、動植物種類等。新聞事件分析:分析新聞圖片,提供事件背景、參與者信息、事件影響等詳細報道,幫助用戶快速了解新聞事件的全貌。教育與學習:在教育領域,輔助學習,例如解釋科學概念、歷史事件,或者提供語言學習中的視覺輔助。電子商務:在電商平臺,基于圖像搜索幫助用戶找到他們想要購買的商品,或者提供商品的詳細信息和評價。旅游規劃:用戶上傳旅游目的地的圖片,獲取景點介紹、旅游攻略、文化背景等信息,輔助用戶規劃行程。

Vision Search Assistant的主要功能視覺內容表述:識別圖像中的關鍵對象、生成描述,考慮對象之間的相關性,這一過程稱為相關表述(Correlated Formulation)。網絡知識搜索:基于一個名為“Chain of Search”的迭代算法,生成多個子問題,用網絡代理搜索相關信息,獲取與用戶問題和圖像內容相關的網絡知識。協作生成:結合原始圖像、用戶的問題、相關表述及通過網絡搜索獲得的知識,用VLM生成最終的答案。多模態搜索引擎:將任意VLM轉變為能理解和響應視覺內容的多模態自動搜索引擎。實時信息訪問:用網絡代理的實時信息訪問能力,讓VLM獲取最新的網絡數據,提高回答的準確性。開放世界檢索增強生成:基于互聯網檢索,擴展VLMs處理新視覺內容的能力,讓其能夠處理和回答有關未見過的圖像或新概念的問題。Vision Search Assistant的技術原理視覺內容識別與描述:用VLM對輸入圖像進行分析,識別出圖像中的關鍵對象,生成描述對象的文本。相關性分析:生成單個對象的描述,分析對象之間的相關性,生成一個綜合考慮這些關系的文本表示,即相關表述。子問題生成:基于用戶的問題和相關表述,VSA用大型語言模型(LLM)生成一系列子問題,子問題引導搜索過程,找到更具體的信息。網絡搜索與知識整合:基于網絡代理執行子問題搜索,分析搜索引擎返回的網頁,提取、總結相關信息,形成網絡知識。迭代搜索過程:用“Chain of Search”算法,基于迭代過程逐步細化搜索,獲得更豐富、更準確的網絡知識。Vision Search Assistant的項目地址項目官網:cnzzx.github.io/VSAGitHub倉庫:https://github.com/cnzzx/VSAarXiv技術論文:https://arxiv.org/pdf/2410.21220Vision Search Assistant的應用場景圖像識別與搜索:用戶上傳一張圖片,識別圖片中的內容并提供相關信息,例如識別歷史人物、地標、動植物種類等。新聞事件分析:分析新聞圖片,提供事件背景、參與者信息、事件影響等詳細報道,幫助用戶快速了解新聞事件的全貌。教育與學習:在教育領域,輔助學習,例如解釋科學概念、歷史事件,或者提供語言學習中的視覺輔助。電子商務:在電商平臺,基于圖像搜索幫助用戶找到他們想要購買的商品,或者提供商品的詳細信息和評價。旅游規劃:用戶上傳旅游目的地的圖片,獲取景點介紹、旅游攻略、文化背景等信息,輔助用戶規劃行程。