提高重建質(zhì)量并保留復(fù)雜的細(xì)節(jié)

(中國AI網(wǎng) 2025年05月20日)從復(fù)雜場景中的單個RGB圖像精確重建3D物體是虛擬現(xiàn)實(shí)等領(lǐng)域的關(guān)鍵挑戰(zhàn)。現(xiàn)有的神經(jīng)隱式三維表示方法在平衡全局和局部特征提取方面存在非常大的困難,特別是在多樣化和復(fù)雜的環(huán)境中,重建精度和質(zhì)量不足。

在一項研究中,日本筑波大學(xué)和香港理工大學(xué)團(tuán)隊提出了M3D,一個新穎的單視圖三維重建框架。

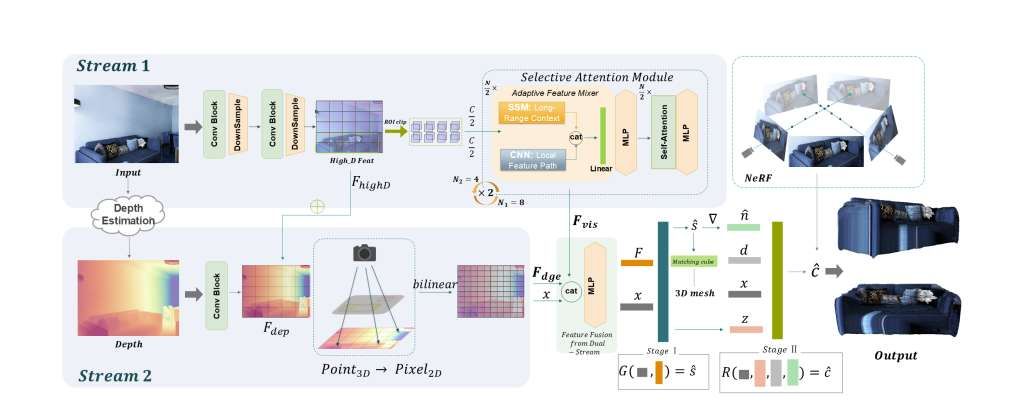

所述框架采用基于選擇性狀態(tài)空間的雙流特征提取策略,有效地平衡了全局特征和局部特征的提取,從而提高了場景的理解和表示精度。另外,并行分支提取深度信息,有效地整合視覺和幾何特征,以提高重建質(zhì)量并保留復(fù)雜的細(xì)節(jié)。

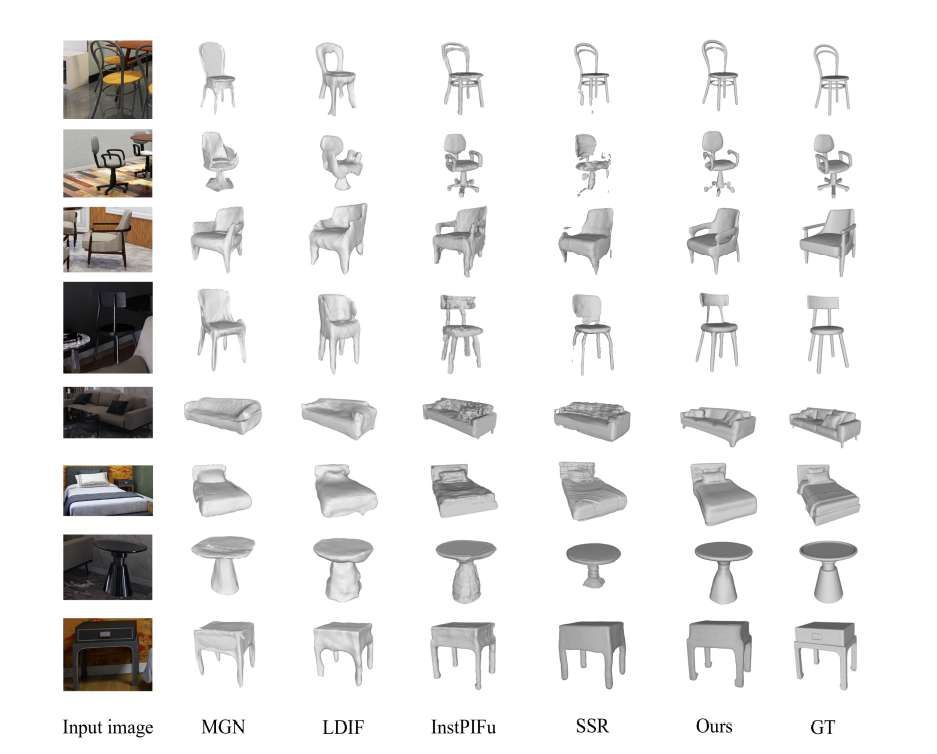

實(shí)驗結(jié)果表明,通過雙分支特征提取將多尺度特征與深度信息融合,顯著提高了圖像的幾何一致性和保真度,實(shí)現(xiàn)了最先進(jìn)的重建性能。

近年來,由于在虛擬現(xiàn)實(shí)等領(lǐng)域的廣泛應(yīng)用,對單視圖圖像的高保真度3D重建的需求激增。單視圖三維重建旨在從單個RGB圖像推斷物體的完整三維結(jié)構(gòu)。但由于固有的模糊性和缺乏深度信息,這是一項具有挑戰(zhàn)性的任務(wù)。

為了實(shí)現(xiàn)精確和魯棒的3D重建,模型必須有效地捕獲全局和局部特征來表示對象結(jié)構(gòu),同時保持場景復(fù)雜性。現(xiàn)有的方法在這一領(lǐng)域取得了進(jìn)展,但依然存在顯著的局限性。

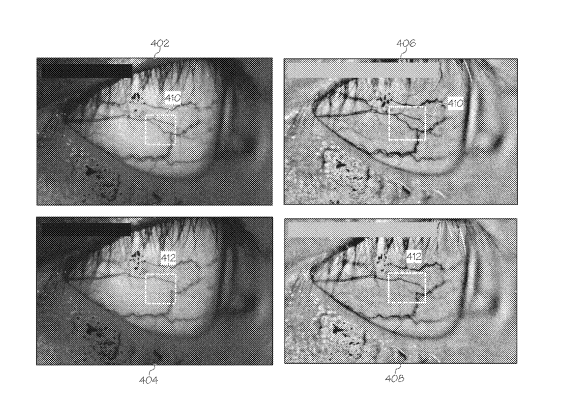

卷積神經(jīng)網(wǎng)絡(luò)CNN在三維重建中廣泛應(yīng)用,擅長提取局部特征。然而,它們有限的接受野阻礙了其捕獲全局背景的能力,經(jīng)常導(dǎo)致在有遮擋的復(fù)雜場景中出現(xiàn)不完整或扭曲的幾何形狀。

另一方面,基于transformer的架構(gòu)可以有效地捕獲遠(yuǎn)程依賴關(guān)系,但通常無法對復(fù)雜的局部細(xì)節(jié)進(jìn)行建模,特別是在重構(gòu)具有復(fù)雜幾何形狀的對象時。所述限制突出了提高單視圖三維重建質(zhì)量的主要瓶頸。

為了解決相關(guān)問題,最近的研究提出了各種方法來增強(qiáng)特征提取,例如聯(lián)合布局和物體網(wǎng)格重建的方法,從單幅圖像中實(shí)現(xiàn)全面的三維理解。類似地,有人使用隱式表示來模擬整體場景理解。

盡管業(yè)界提出的方法對3D重建的進(jìn)步做出了重大貢獻(xiàn),但在實(shí)現(xiàn)全局結(jié)構(gòu)和局部細(xì)節(jié)的平衡特征提取方面依然存在挑戰(zhàn)。

引入深度信息有助于解決遮擋區(qū)域的模糊問題,并通過增強(qiáng)幾何一致性和解決復(fù)雜場景中的模糊問題來提高幾何一致性。因此,日本筑波大學(xué)和香港理工大學(xué)團(tuán)隊設(shè)計了一個雙流結(jié)構(gòu),有效地將深度信息融入到模型中。

基于先前研究的上述局限性,研究人員提出了M3D框架,這是一種用于單視圖3D重建的新型雙流特征提取框架。這種新穎的方法通過雙流特征提取策略解決了單視圖3D重建的挑戰(zhàn)。

所提出的框架集成了選擇性狀態(tài)空間模型(SSM),它結(jié)合了用于捕獲淺層特征的優(yōu)化殘差卷積層和用于獲取遠(yuǎn)程上下文信息的基于transformer的組件。這種設(shè)計有效地平衡了全局特征和局部特征的提取,增強(qiáng)了模型對復(fù)雜場景的理解。

觀察遮擋對重建精度的影響,所以他們進(jìn)一步引入了專用的深度估計流,以精確的幾何背景補(bǔ)充RGB特征。這種雙流結(jié)構(gòu)使模型能夠從RGB和深度數(shù)據(jù)中捕獲互補(bǔ)信息,從而顯著提高重建質(zhì)量和細(xì)節(jié)精度。

深度估計模塊采用了最先進(jìn)的單圖像深度估計模型,提高了精度,同時減少了計算負(fù)擔(dān),為特征提取提供了一致的幾何基礎(chǔ)。實(shí)驗表明,M3D在具有遮擋和復(fù)雜細(xì)節(jié)的復(fù)雜場景中表現(xiàn)更好,顯著優(yōu)于現(xiàn)有方法。具體來說,與Front3D數(shù)據(jù)集上的基線方法相比,M3D在CD方面提高了36.9%,F(xiàn)-score提高了13.3%,NC方面則提高了5.5%。

相關(guān)論文:M3D: Dual-Stream Selective State Spaces and Depth-Driven Framework for High-Fidelity Single-View 3D Reconstruction

總的來說,團(tuán)隊提出的M3D是一個單視圖三維重建框架,并解決了全局和局部特征集成的限制。通過利用雙流架構(gòu),結(jié)合深度引導(dǎo)的幾何特征和選擇性SSM增強(qiáng)上下文建模,M3D實(shí)現(xiàn)高保真重建,具有卓越的精度和細(xì)節(jié)。

消融研究驗證了每個模塊的貢獻(xiàn),展示了在深度信息、優(yōu)化剩余塊和高級特征融合的重建指標(biāo)方面的實(shí)質(zhì)性改進(jìn)。考慮到3D數(shù)據(jù)集的稀缺性,團(tuán)隊的目標(biāo)是通過探索半監(jiān)督學(xué)習(xí)來減少數(shù)據(jù)依賴性。這一進(jìn)步將大大有利于高質(zhì)量的3D重建更容易用于虛擬現(xiàn)實(shí)等領(lǐng)域。