輕量級的結(jié)構(gòu)化3DGS

(中國AI網(wǎng) 2025年05月23日)隨著虛擬現(xiàn)實(shí)應(yīng)用的廣泛應(yīng)用,3D場景生成已成為一個(gè)新的挑戰(zhàn)性研究前沿。3D場景具有高度復(fù)雜的結(jié)構(gòu),需要確保輸出是密集的,連貫的,并包含所有必要的結(jié)構(gòu)。目前大多數(shù)3D場景生成方法依賴于預(yù)訓(xùn)練的文本到圖像擴(kuò)散模型和單目深度估計(jì)器。然而,生成的場景占用了大量的存儲(chǔ)空間,并且往往缺乏有效的正則化方法,導(dǎo)致幾何扭曲。

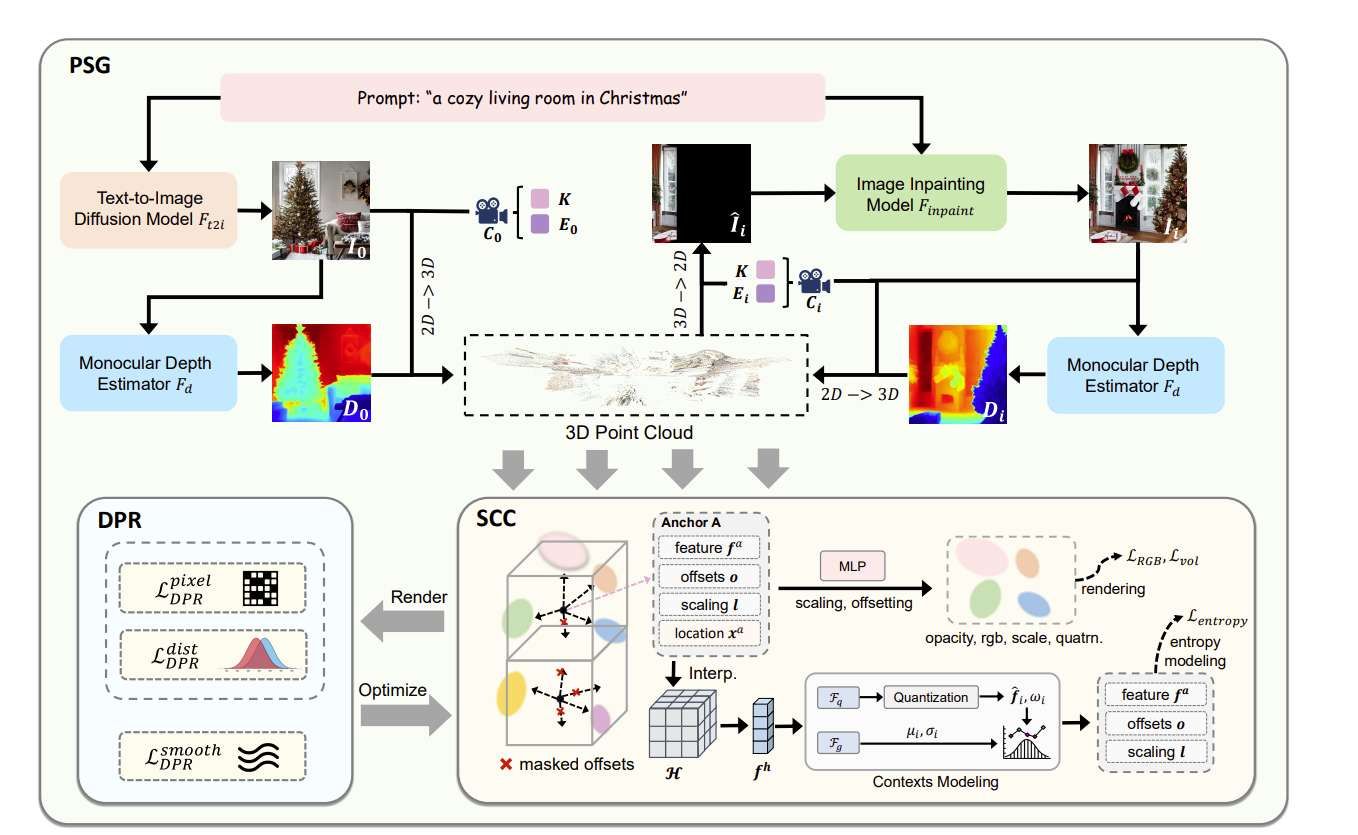

在一項(xiàng)研究中,由復(fù)旦大學(xué)和字節(jié)跳動(dòng)等機(jī)構(gòu)組成的團(tuán)隊(duì)提出了BloomScene。這個(gè)輕量級的結(jié)構(gòu)化3DGS用于跨模式場景生成,可以從文本或圖像輸入中創(chuàng)建多樣化和高質(zhì)量的3D場景。具體而言,研究人員提出了一種利用增量點(diǎn)云重建和3DGS生成連貫場景的跨模漸進(jìn)場景生成框架。

另外,他們提出了一種基于層次深度先驗(yàn)的正則化機(jī)制,利用深度精度和平滑度的多級約束來增強(qiáng)生成場景的真實(shí)感和連續(xù)性。

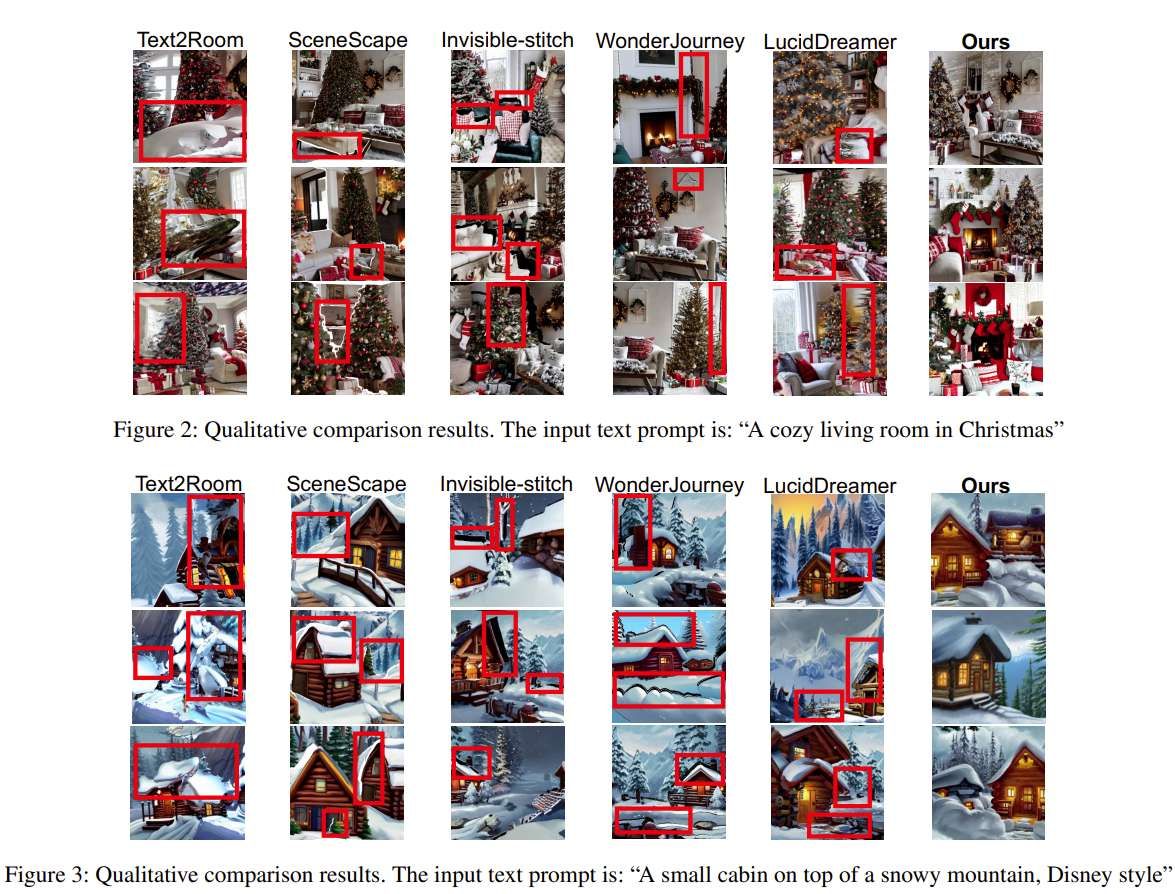

最后,團(tuán)隊(duì)提出了一種結(jié)構(gòu)化上下文導(dǎo)向的壓縮機(jī)制,利用結(jié)構(gòu)化哈希網(wǎng)格對無組織錨屬性的上下文進(jìn)行建模,從而顯著消除了結(jié)構(gòu)冗余并降低了存儲(chǔ)開銷。跨多個(gè)場景的綜合實(shí)驗(yàn)表明,與多個(gè)基線相比,所提出框架具有顯著的潛力和優(yōu)勢。

目前,人們對虛擬現(xiàn)實(shí)中的3D內(nèi)容需求越來越大。然而,創(chuàng)建3D內(nèi)容非常耗時(shí),并且需要深厚的專業(yè)知識,這使得3D內(nèi)容生成成為一個(gè)具有挑戰(zhàn)性的前沿。在2D領(lǐng)域,足夠多的帶注釋數(shù)據(jù)集極大地促進(jìn)了文本到圖像生成模型的發(fā)展,使得用戶能夠通過自然語言生成圖像。

然而,缺乏帶注釋3D數(shù)據(jù)集限制了監(jiān)督學(xué)習(xí)在3D內(nèi)容生成中的應(yīng)用。為了應(yīng)對這一挑戰(zhàn),最近的研究通過耗時(shí)的蒸餾過程從擴(kuò)散模型中提取2D先驗(yàn),以優(yōu)化3D內(nèi)容的生成。然而,相關(guān)方法在擴(kuò)展到細(xì)粒度場景時(shí)存在局限性。

隨著NeRF 在新穎視圖合成任務(wù)中的廣泛應(yīng)用,Text2NeRF以漸進(jìn)式框架生成以NeRF為代表的3D場景。盡管這種方法可以生成高質(zhì)量的場景,但生成時(shí)間比較長。近年來,3DGS由于其出色的生成質(zhì)量和實(shí)時(shí)渲染能力,廣泛用于高質(zhì)量的場景生成。

盡管之前基于3DGS的方法在3D場景生成方面取得了進(jìn)展,但它們依然存在以下局限性:

在場景優(yōu)化過程中僅依賴光度損失,缺乏足夠的正則化技術(shù),容易產(chǎn)生偽影和歧義。

3DGS需要數(shù)百萬個(gè)3D高斯來表示每個(gè)場景,導(dǎo)致高內(nèi)存需求,增加存儲(chǔ)成本,增加終端設(shè)備負(fù)擔(dān)。

為了解決上述問題,團(tuán)隊(duì)提出了Bloom Scene,一種輕量級的結(jié)構(gòu)化3DGS,并用于高質(zhì)量的跨模態(tài)3D場景生成。

BloomScene有以下三個(gè)核心貢獻(xiàn):

提出了一個(gè)跨模漸進(jìn)場景生成框架,通過漸進(jìn)點(diǎn)云重建和3DGS來生成3D場景。

提出了一種基于層次深度先驗(yàn)的正則化機(jī)制,通過實(shí)施多層次深度精度約束和平滑性約束來增強(qiáng)場景的真實(shí)感和連續(xù)性。

提出了一種結(jié)構(gòu)化上下文導(dǎo)向的壓縮機(jī)制,利用結(jié)構(gòu)化哈希網(wǎng)格對無組織錨屬性的上下文進(jìn)行建模,從而充分壓縮模型存儲(chǔ)空間。

為了最大限度地提高所提出的BloomScene的泛化能力,團(tuán)隊(duì)使用預(yù)訓(xùn)練的模型來構(gòu)建整個(gè)架構(gòu)。具體來說,Stable Diffusion v1.5用于從文本提示生成初始圖像。如果輸入是沒有相應(yīng)文本描述的圖像,則使用LLaVa 從圖像生成相應(yīng)的文本提示,從而構(gòu)成圖像-文本對。

他們使用Stable Diffusion v1.5 Inpainting模型作為文本條件下的圖像Inpainting模型,并將ZoeDepth作為單目深度估計(jì)器。為了生成3D場景,以0.63弧度的旋轉(zhuǎn)移動(dòng)攝像頭。所有的實(shí)驗(yàn)都是在單個(gè)NVIDIA A800 GPU完成。

綜合實(shí)驗(yàn)表明,框架生成的場景在保真度和幾何一致性方面明顯優(yōu)于基線,證明了其在復(fù)雜3D場景生成中的巨大潛力和優(yōu)勢。

相關(guān)論文:BloomScene: Lightweight Structured 3D Gaussian Splatting for Crossmodal Scene Generation

總的來說,BloomScene是一個(gè)輕量級的結(jié)構(gòu)化3DGS,用于跨模態(tài)場景生成。具體而言,他們提出了一種跨模式漸進(jìn)場景生成框架,用于增量生成連貫場景。另外,基于層次深度先驗(yàn)的正則化機(jī)制利用深度精度和平滑度的多級約束來增強(qiáng)生成場景的真實(shí)感和連續(xù)性。最后,結(jié)構(gòu)化上下文導(dǎo)向的壓縮機(jī)制利用結(jié)構(gòu)化哈希網(wǎng)格對無組織錨屬性的上下文進(jìn)行建模,從而顯著降低了存儲(chǔ)開銷。

跨多個(gè)場景的綜合定性和定量實(shí)驗(yàn)表明,所提出的框架比多個(gè)基線具有顯著的優(yōu)勢。團(tuán)隊(duì)指出,所述框架為未來的虛擬現(xiàn)實(shí)應(yīng)用開辟了更多的可能性。