動態(tài)街道場景的精確重建

(中國AI網(wǎng) 2025年06月26日)動態(tài)街道場景的精確重建對于自增強現(xiàn)實和虛擬現(xiàn)實等應用至關重要。傳統(tǒng)的方法依賴于密集的點云和三角形網(wǎng)格,難以應對移動物體、遮擋和實時處理的限制,限制了它們在復雜城市環(huán)境中的有效性。盡管多視圖立體和神經(jīng)輻射場帶來了先進的3D重建技術,但它們在計算效率和處理場景動態(tài)方面面臨挑戰(zhàn)。

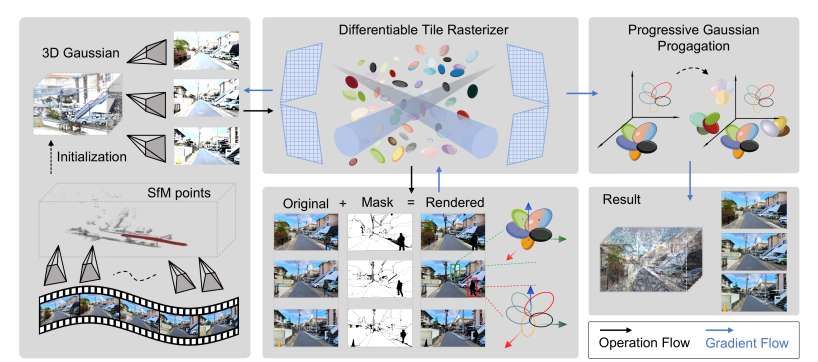

在一項研究中,ThinkX和MedicineX團隊提出了一種新的動態(tài)街景重建的三維高斯點分布方法。他們引入了一種自適應透明機制,消除了移動物體,同時保留了高保真的靜態(tài)場景細節(jié)。另外,高斯點分布的迭代細化提高了幾何精度和紋理表示。研究人員將方向編碼與空間位置優(yōu)化相結合,以優(yōu)化存儲和渲染效率,在保持場景完整性的同時減少冗余。

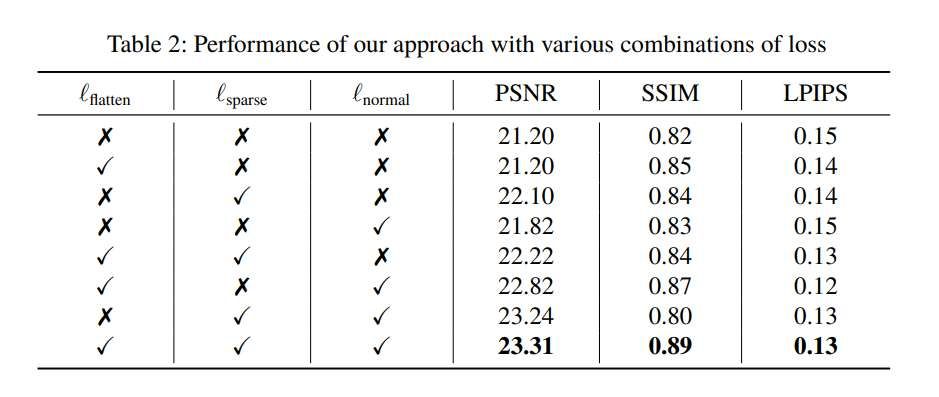

實驗結果表明,所提出方法具有較高的重建質(zhì)量和較好的渲染性能,并能適應大規(guī)模動態(tài)環(huán)境。相關貢獻為實時、高精度3D重建建立了一個強大的框架,推進了動態(tài)場景建模的實用性。

增強現(xiàn)實和虛擬現(xiàn)實技術的快速發(fā)展提高了對精確3D場景重建的需求。準確捕獲和重建現(xiàn)實世界環(huán)境,特別是在復雜的城市環(huán)境中,對于增強交互體驗和場景理解至關重要。高精度的三維街景重建通過提高動態(tài)環(huán)境下的感知和決策能力。

傳統(tǒng)的3D街景重建方法主要依賴于密集的點云或三角形網(wǎng)格。它們從多個視點捕獲的圖像或光探測和測距(LiDAR)數(shù)據(jù)中提取特征,以生成密集的3D點云。盡管所述方法可以在靜態(tài)環(huán)境中實現(xiàn)較高的重建精度,例如有效地建模建筑物,道路和樹木,但它們在動態(tài)場景中面臨重大挑戰(zhàn)。

具體來說,移動的物體和場景變化是挑戰(zhàn),往往導致不準確的重建。密集點云方法的一個主要限制是它們假設場景保持靜態(tài)。在動態(tài)環(huán)境中(持續(xù)的交通運動和不斷變化的天氣條件),傳統(tǒng)方法無法區(qū)分靜態(tài)背景和運動物體,導致錯誤地將車輛、行人或其他運動元素納入重建模型。這導致了不現(xiàn)實的陳述,扭曲了整體場景,降低了可信度。

同樣,盡管三角網(wǎng)格方法可以產(chǎn)生高質(zhì)量的表面模型,但它們通常需要復雜的算法來分離運動物體和更新場景,這使得實時處理變得不切實際。相關限制突出了需要更先進的方法來提高動態(tài)街景重建的準確性、效率和可擴展性。

近年來,多視點立體(MVS)技術通過從多個視點拍攝的圖像估計場景深度,從而產(chǎn)生密集的3D點云,在3D重建中發(fā)揮了至關重要的作用。

傳統(tǒng)的MVS方法依靠圖像配準和幾何優(yōu)化來提高重建精度和完整性。然而,隨著場景復雜性和動態(tài)性的增加,MVS面臨著快速運動和遮擋等挑戰(zhàn),限制了其在動態(tài)環(huán)境中的有效性。因此,深度學習納入其中。例如,DeepMVS利用深度神經(jīng)網(wǎng)絡從圖像中學習深度信息,提高對遮擋和光照變化的魯棒性。然而,基于MVS的方法依然面臨著持續(xù)的挑戰(zhàn),包括視點之間的不一致性、分離運動物體的困難以及高昂的計算成本。

相關問題在復雜和高度動態(tài)的街景環(huán)境中尤為突出,需要進一步改進。隨著研究的進展,神經(jīng)輻射場(NeRF) 已成為多視圖場景建模的一個有前途的替代方案。NeRF擅長于逼真的渲染,但依賴于高密度采樣和復雜的神經(jīng)網(wǎng)絡推理,使得實時處理的計算成本很高。它在街景中捕捉精細幾何細節(jié)和區(qū)分運動物體的能力依然有限。

傳統(tǒng)的基于點云的表示,如顯式網(wǎng)格和體像素化,提高了渲染效率,但它們往往依賴于稀疏的點云初始化,降低了它們在動態(tài)和復雜場景中的適應性。為了克服所述挑戰(zhàn),3DGS通過高斯分布表示場景,從而實現(xiàn)了渲染效率和幾何細節(jié)保存之間的平衡。然而,3DGS依然無法解決在分離運動物體、優(yōu)化存儲要求和確保多視圖一致性方面的挑戰(zhàn)。

這凸顯了需要進一步發(fā)展,以增強3DGS在現(xiàn)實世界動態(tài)環(huán)境中的適用性。在研究中,ThinkX和MedicineX團隊提出了一種新的針對運動物體的GaussianMove,并用于高保真動態(tài)街景重建。所述方法通過增強高斯點的空間表示和編碼機制,同時優(yōu)化動態(tài)區(qū)域的透明度設置,有效地去除運動物體。實驗結果表明,它在動態(tài)街道環(huán)境中具有較高的重建質(zhì)量和渲染效率。

總的來說,團隊提出了一種基于三維高斯點分布技術的動態(tài)街景重建方法。所述方法利用運動目標區(qū)域的自適應透明度優(yōu)化、漸進式動態(tài)場景渲染框架以及新穎的高斯點編碼和存儲機制,實現(xiàn)了高保真動態(tài)場景重構和運動目標去除。

團隊提出的解決方案通過自適應透明度優(yōu)化,結合多視圖一致性約束和高斯分布的固有特性,有效地減輕了運動物體的干擾。這允許對背景和靜態(tài)場景元素進行精確建模。同時,漸進式動態(tài)場景渲染框架通過增量調(diào)整高斯點分布和透明度設置,優(yōu)化了移動物體的去除,增強了靜態(tài)場景的細節(jié)。

采用新穎的高斯點編碼和存儲機制,結合方向編碼和空間位置優(yōu)化,這顯著降低了冗余和存儲需求,保證了大規(guī)模動態(tài)場景的高效渲染性能和幾何完整性。

實驗結果表明,所述方法在動態(tài)街景重建精度、渲染效率和運動目標分離能力等方面均優(yōu)于傳統(tǒng)方法,并為虛擬現(xiàn)實和增強現(xiàn)實等應用中的動態(tài)場景建模和渲染提供了高效、準確的解決方案。

相關論文:3D Gaussian Splatting against Moving Objects for High-Fidelity Street Scene Reconstruction

相關論文:https://arxiv.org/pdf/2503.12001

團隊表示,這一方法不僅解決了傳統(tǒng)動態(tài)場景處理技術的局限性,而且為未來復雜動態(tài)場景的高效建模提供了有價值的見解和技術支持。