Mini-LLaVA是一款輕量級的多模態大語言模型,由清華大學和北京航空航天大學的研究團隊聯合開發。能處理圖像、文本和視頻輸入,實現高效的多模態數據處理。Mini-LLaVA基于Llama 3.1模型,優化了代碼結構,在單個GPU上即可運行,適合復雜的視覺-文本關聯任務。項目已在GitHub上開源,便于研究者和開發者下載使用。Mini-LLaVA的設計注重代碼的可讀性和功能的擴展性,支持定制和微調,適應不同的應用場景。

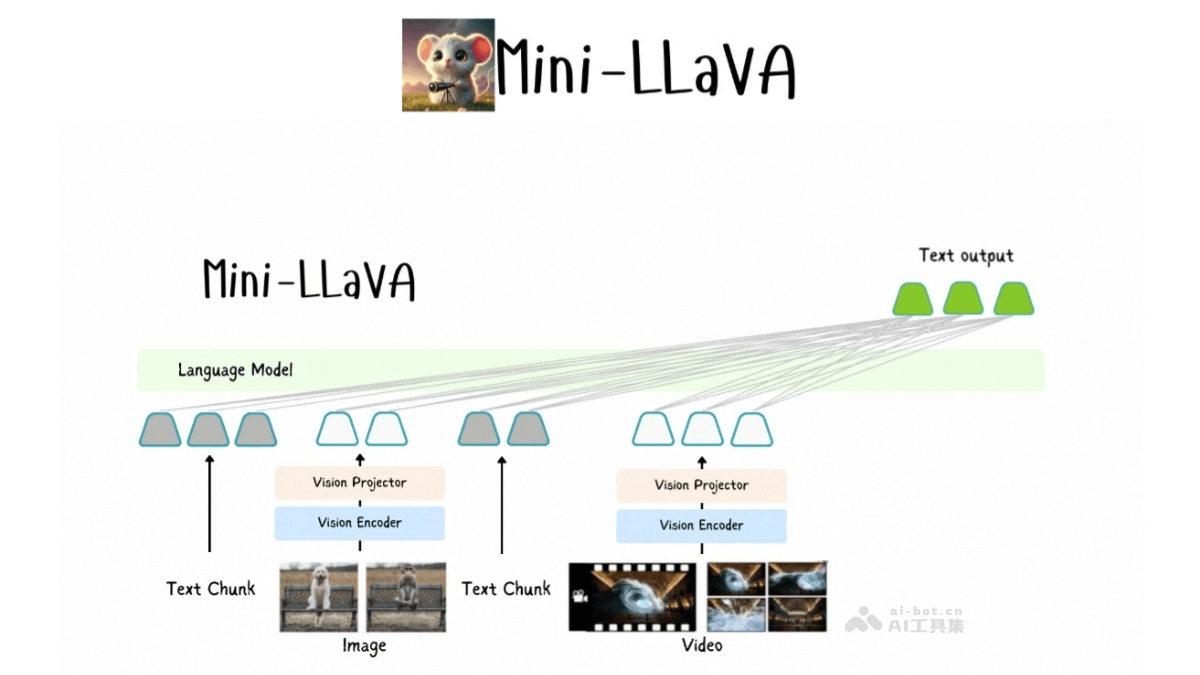

Mini-LLaVA的主要功能圖像理解:模型分析圖像內容,根據圖像內容生成描述或回答相關問題。視頻分析:Mini-LLaVA能處理視頻數據,理解視頻內容,并提供相應的文本輸出。文本生成:基于輸入的圖像或視頻,模型生成相關的文本描述或總結。視覺-文本關聯:模型能理解圖像和文本之間的關聯,并在生成的文本中反映這種關系。靈活性:基于其輕量級和簡化的代碼結構,Mini-LLaVA能在資源有限的環境中部署,如單個GPU。Mini-LLaVA的技術原理多模態輸入處理:Mini-LLaVA能夠接收和處理多種類型的輸入,包括文本、圖像和視頻。集成視覺編碼器和語言解碼器,實現對不同模態數據的理解和分析。基于Llama 3.1:基于Llama 3.1模型,通過額外的訓練和調整,具備處理視覺數據的能力。簡化的代碼結構:Mini-LLaVA的代碼設計注重簡潔,使模型更容易理解和修改。交錯處理:模型支持交錯處理圖像、視頻和文本,在保持輸入順序的同時,對不同模態的數據進行分析和響應。預訓練適配器:Mini-LLaVA基于預訓練的適配器增強Llama 3.1模型的視覺處理能力,允許模型更好地理解和生成與輸入相關的輸出。Mini-LLaVA的項目地址GitHub倉庫:https://github.com/fangyuan-ksgk/Mini-LLaVAMini-LLaVA的應用場景教育與培訓:作為教學工具,幫助學生理解復雜的概念,通過圖像、視頻和文本的結合提供豐富的學習體驗。內容創作:輔助內容創作者生成圖像描述、視頻字幕或自動化地生成文章和報告。媒體與娛樂:在電影、游戲和視頻制作中,生成劇本、角色對話或自動生成視頻內容的描述。智能助手:作為聊天機器人或虛擬助手的一部分,提供圖像和視頻理解能力,更好地與用戶互動。社交媒體分析:分析社交媒體上的圖像和視頻內容,提取關鍵信息,幫助品牌和個人了解公眾對內容的反應。安全監控:在安全領域,對監控視頻進行實時分析,識別異常行為或事件。

Mini-LLaVA的主要功能圖像理解:模型分析圖像內容,根據圖像內容生成描述或回答相關問題。視頻分析:Mini-LLaVA能處理視頻數據,理解視頻內容,并提供相應的文本輸出。文本生成:基于輸入的圖像或視頻,模型生成相關的文本描述或總結。視覺-文本關聯:模型能理解圖像和文本之間的關聯,并在生成的文本中反映這種關系。靈活性:基于其輕量級和簡化的代碼結構,Mini-LLaVA能在資源有限的環境中部署,如單個GPU。Mini-LLaVA的技術原理多模態輸入處理:Mini-LLaVA能夠接收和處理多種類型的輸入,包括文本、圖像和視頻。集成視覺編碼器和語言解碼器,實現對不同模態數據的理解和分析。基于Llama 3.1:基于Llama 3.1模型,通過額外的訓練和調整,具備處理視覺數據的能力。簡化的代碼結構:Mini-LLaVA的代碼設計注重簡潔,使模型更容易理解和修改。交錯處理:模型支持交錯處理圖像、視頻和文本,在保持輸入順序的同時,對不同模態的數據進行分析和響應。預訓練適配器:Mini-LLaVA基于預訓練的適配器增強Llama 3.1模型的視覺處理能力,允許模型更好地理解和生成與輸入相關的輸出。Mini-LLaVA的項目地址GitHub倉庫:https://github.com/fangyuan-ksgk/Mini-LLaVAMini-LLaVA的應用場景教育與培訓:作為教學工具,幫助學生理解復雜的概念,通過圖像、視頻和文本的結合提供豐富的學習體驗。內容創作:輔助內容創作者生成圖像描述、視頻字幕或自動化地生成文章和報告。媒體與娛樂:在電影、游戲和視頻制作中,生成劇本、角色對話或自動生成視頻內容的描述。智能助手:作為聊天機器人或虛擬助手的一部分,提供圖像和視頻理解能力,更好地與用戶互動。社交媒體分析:分析社交媒體上的圖像和視頻內容,提取關鍵信息,幫助品牌和個人了解公眾對內容的反應。安全監控:在安全領域,對監控視頻進行實時分析,識別異常行為或事件。