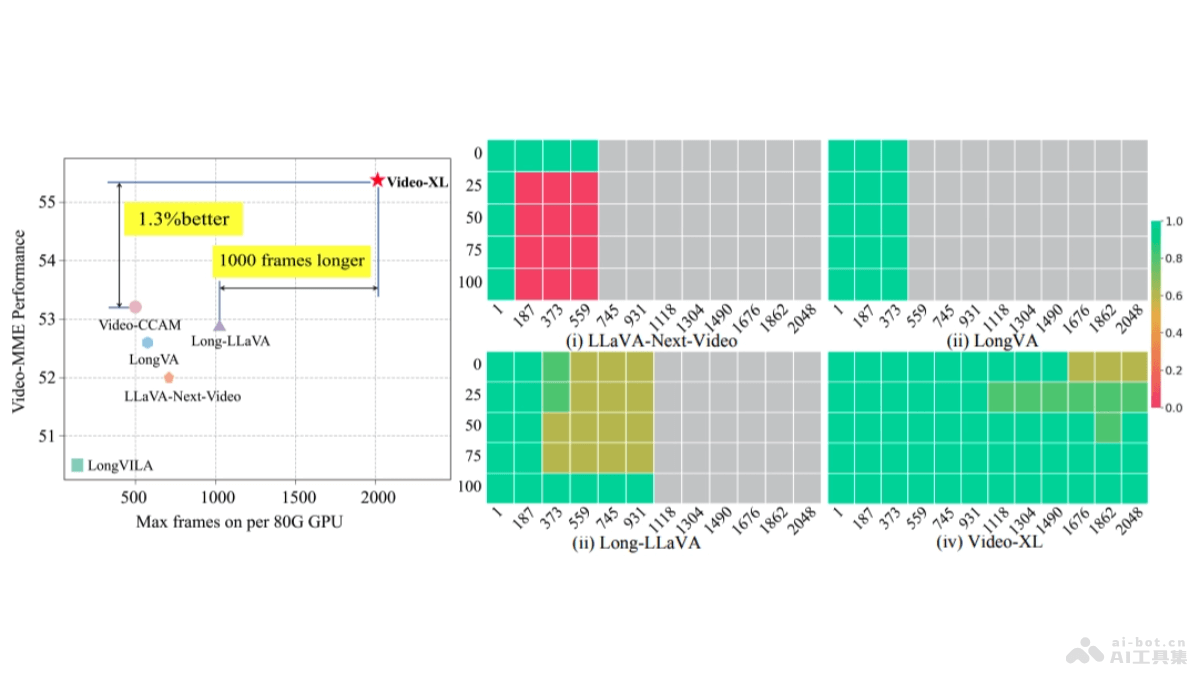

Video-XL是北京智源人工智能研究院聯合上海交大、中國人民大學、中科院、北郵和北大的研究人員共同推出的專為小時級視頻理解設計的超長視覺理解模型。基于視覺上下文潛在總結技術將視覺信息壓縮成緊湊的形式,提高處理效率、減少信息丟失。在多個長視頻理解基準測試中表現出色,例如在VNBench上準確率比現有最佳方法高出近10%,在單個80GB GPU上處理2048幀視頻時,準確率接近95%。Video-XL展示了在效率和效果之間取得平衡的能力,在長視頻特定任務如電影總結、監控異常檢測和廣告放置識別等方面具有潛力。

Video-XL的主要功能小時級視頻理解:Video-XL能處理非常長的視頻,達到小時級別的視頻內容理解。視覺壓縮:基于視覺上下文潛在總結技術,將大量的視覺信息壓縮成更緊湊的形式,適應模型的處理能力。高效計算:在保持高準確率的同時,減少計算資源消耗,在單個GPU上能處理大量視頻幀。多模態數據處理:處理包括單圖像、多圖像和視頻在內的多種數據類型。長視頻特定任務處理:適于電影總結、監控異常檢測和廣告放置識別等長視頻相關的特定任務。Video-XL的技術原理視覺上下文潛在總結(Visual Context Latent Summarization):引入視覺總結標記(VSTs),將原始視覺上下文的激活(例如自注意力模塊中的鍵和值)壓縮成高度緊湊的表示。分塊處理:將視覺標記序列分割成相同大小的塊,在每個塊中插入VSTs,用LLM逐步壓縮視覺信號。自回歸方法:在編碼每個塊的過程中,除了用額外的投影矩陣外,Video-XL重用所有模塊轉換VST隱藏狀態,將視覺信號的信息壓縮到VST的激活中。統一的視覺編碼方案:將單圖像、多圖像和視頻統一編碼到同一空間,處理不同的多模態數據。長視頻數據集(VICO):開發新的長視頻數據集,專門用在處理更長的視頻和動態視覺上下文,增強模型的長視頻理解能力。Video-XL的項目地址GitHub倉庫:https://github.com/VectorSpaceLab/Video-XLHuggingFace模型庫:https://huggingface.co/sy1998/Video_XLarXiv技術論文:https://arxiv.org/pdf/2409.14485Video-XL的應用場景電影和視頻內容總結:Video-XL能理解和總結長視頻內容,如電影或電視劇的主要情節和事件,為用戶提供簡潔的概述。視頻監控分析:在安全監控領域,用在異常行為檢測,識別監控視頻中的異常事件或不尋常活動。廣告投放和分析:Video-XL幫助分析視頻內容中的廣告放置效果,理解廣告與視頻內容的關聯性,及觀眾對廣告的反應。教育和培訓視頻:在教育領域,Video-XL用在理解和總結長時間的教學視頻,幫助學生快速把握課程要點。視頻內容檢索:Video-XL用在視頻數據庫中的內容檢索,幫助用戶快速找到視頻中的關鍵片段或相關信息。

Video-XL的主要功能小時級視頻理解:Video-XL能處理非常長的視頻,達到小時級別的視頻內容理解。視覺壓縮:基于視覺上下文潛在總結技術,將大量的視覺信息壓縮成更緊湊的形式,適應模型的處理能力。高效計算:在保持高準確率的同時,減少計算資源消耗,在單個GPU上能處理大量視頻幀。多模態數據處理:處理包括單圖像、多圖像和視頻在內的多種數據類型。長視頻特定任務處理:適于電影總結、監控異常檢測和廣告放置識別等長視頻相關的特定任務。Video-XL的技術原理視覺上下文潛在總結(Visual Context Latent Summarization):引入視覺總結標記(VSTs),將原始視覺上下文的激活(例如自注意力模塊中的鍵和值)壓縮成高度緊湊的表示。分塊處理:將視覺標記序列分割成相同大小的塊,在每個塊中插入VSTs,用LLM逐步壓縮視覺信號。自回歸方法:在編碼每個塊的過程中,除了用額外的投影矩陣外,Video-XL重用所有模塊轉換VST隱藏狀態,將視覺信號的信息壓縮到VST的激活中。統一的視覺編碼方案:將單圖像、多圖像和視頻統一編碼到同一空間,處理不同的多模態數據。長視頻數據集(VICO):開發新的長視頻數據集,專門用在處理更長的視頻和動態視覺上下文,增強模型的長視頻理解能力。Video-XL的項目地址GitHub倉庫:https://github.com/VectorSpaceLab/Video-XLHuggingFace模型庫:https://huggingface.co/sy1998/Video_XLarXiv技術論文:https://arxiv.org/pdf/2409.14485Video-XL的應用場景電影和視頻內容總結:Video-XL能理解和總結長視頻內容,如電影或電視劇的主要情節和事件,為用戶提供簡潔的概述。視頻監控分析:在安全監控領域,用在異常行為檢測,識別監控視頻中的異常事件或不尋常活動。廣告投放和分析:Video-XL幫助分析視頻內容中的廣告放置效果,理解廣告與視頻內容的關聯性,及觀眾對廣告的反應。教育和培訓視頻:在教育領域,Video-XL用在理解和總結長時間的教學視頻,幫助學生快速把握課程要點。視頻內容檢索:Video-XL用在視頻數據庫中的內容檢索,幫助用戶快速找到視頻中的關鍵片段或相關信息。