EzAudio是由約翰霍普金斯大學和騰訊AI實驗室共同推出的一款文本到音頻(Text-to-Audio, T2A)生成模型。基于一種高效的擴散變換器技術,用在從文本提示生成高質量的音頻效果。EzAudio的創新之處在于優化的模型架構和數據高效訓練策略,在生成速度、效率和音頻真實感方面都達到新標準。EzAudio引入無分類器引導重縮放技術,簡化模型使用保持音頻質量。

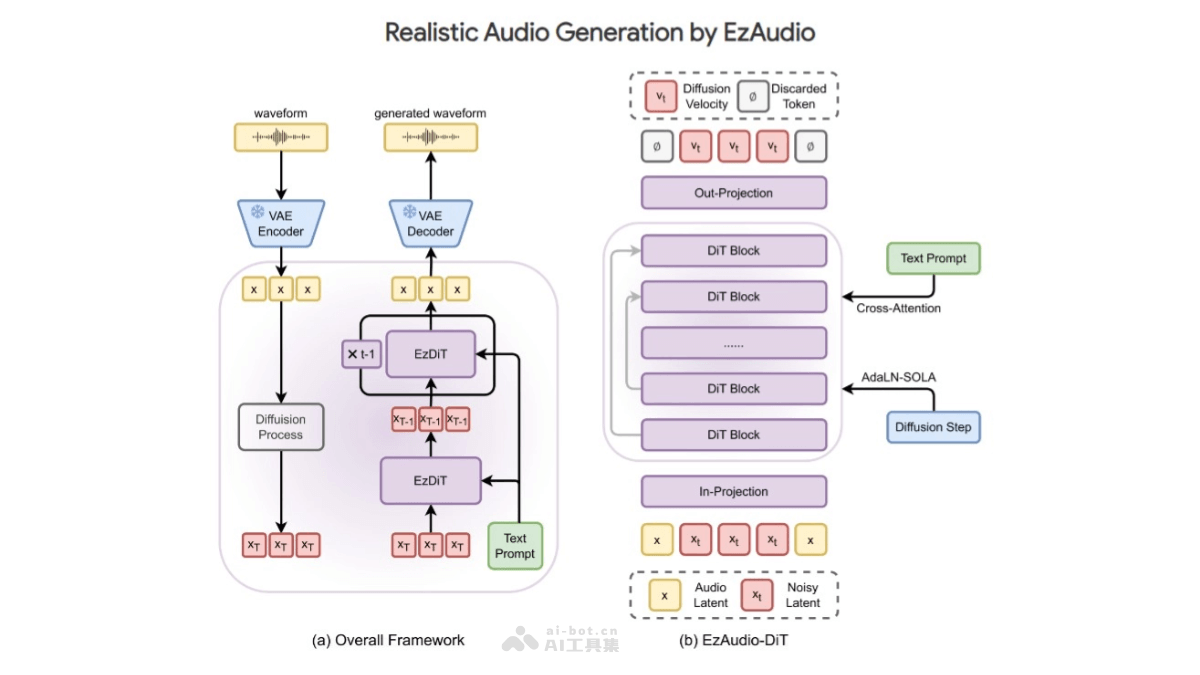

?EzAudio的主要功能文本到音頻生成:根據給定的文本提示生成相應的音頻內容。高效率:優化的模型架構減少計算資源的需求,提高生成速度。高質量音頻:生成的音頻具有高保真度,提供逼真的聽覺體驗。數據高效訓練:基于未標記數據和人工標記數據,提高訓練效率和模型性能。?EzAudio的技術原理波形VAE:基于一維波形變分自動編碼器(VAE)處理音頻數據,避免處理二維頻譜圖的復雜性,減少計算成本,同時保持高時間分辨率。優化的擴散變換器架構(EzAudio-DiT):定制的擴散模型,包括AdaLN-SOLA和長跳躍連接,提高模型的參數和內存效率,同時保持訓練的穩定性。多階段訓練策略:結合自監督學習和監督學習,用掩碼擴散建模和合成字幕數據進行訓練,最后在人工標注數據上微調,提高音頻生成的準確性和質量。無分類器引導重縮放(CFG Rescaling):在擴散采樣過程中調整引導強度,優化文本到音頻的對齊,減少對音頻質量的負面影響。?EzAudio的項目地址項目官網:haidog-yaqub.github.io/EzAudio-PageGitHub倉庫:https://github.com/haidog-yaqub/EzAudio技術論文:https://haidog-yaqub.github.io/EzAudio-Page/static/pdf/ezaudio.pdf?EzAudio的應用場景音樂創作:根據文本描述生成特定風格或情感的音樂片段,輔助音樂家和制作人進行創作。影視后期制作:為電影、電視劇或視頻游戲生成逼真的音效和配音,提高觀眾的沉浸感。語音合成:生成標準或特定語調的語音,用在教育軟件、有聲讀物或語言學習應用。音頻編輯:對現有音頻進行編輯和修改,無需復雜的音頻編輯工具。虛擬助手和聊天機器人:為虛擬助手和聊天機器人生成自然聽起來的語音響應。有聲內容創作:自動生成有聲博客、播客或新聞內容的音頻。

?EzAudio的主要功能文本到音頻生成:根據給定的文本提示生成相應的音頻內容。高效率:優化的模型架構減少計算資源的需求,提高生成速度。高質量音頻:生成的音頻具有高保真度,提供逼真的聽覺體驗。數據高效訓練:基于未標記數據和人工標記數據,提高訓練效率和模型性能。?EzAudio的技術原理波形VAE:基于一維波形變分自動編碼器(VAE)處理音頻數據,避免處理二維頻譜圖的復雜性,減少計算成本,同時保持高時間分辨率。優化的擴散變換器架構(EzAudio-DiT):定制的擴散模型,包括AdaLN-SOLA和長跳躍連接,提高模型的參數和內存效率,同時保持訓練的穩定性。多階段訓練策略:結合自監督學習和監督學習,用掩碼擴散建模和合成字幕數據進行訓練,最后在人工標注數據上微調,提高音頻生成的準確性和質量。無分類器引導重縮放(CFG Rescaling):在擴散采樣過程中調整引導強度,優化文本到音頻的對齊,減少對音頻質量的負面影響。?EzAudio的項目地址項目官網:haidog-yaqub.github.io/EzAudio-PageGitHub倉庫:https://github.com/haidog-yaqub/EzAudio技術論文:https://haidog-yaqub.github.io/EzAudio-Page/static/pdf/ezaudio.pdf?EzAudio的應用場景音樂創作:根據文本描述生成特定風格或情感的音樂片段,輔助音樂家和制作人進行創作。影視后期制作:為電影、電視劇或視頻游戲生成逼真的音效和配音,提高觀眾的沉浸感。語音合成:生成標準或特定語調的語音,用在教育軟件、有聲讀物或語言學習應用。音頻編輯:對現有音頻進行編輯和修改,無需復雜的音頻編輯工具。虛擬助手和聊天機器人:為虛擬助手和聊天機器人生成自然聽起來的語音響應。有聲內容創作:自動生成有聲博客、播客或新聞內容的音頻。