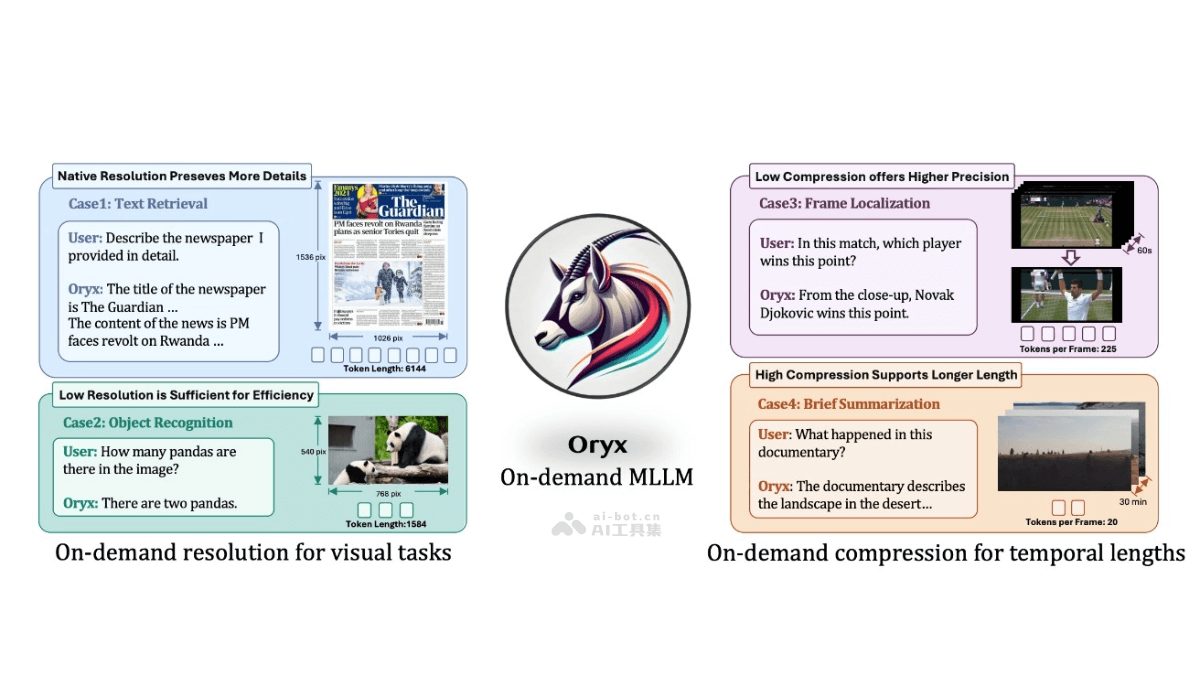

Oryx是由清華大學、騰訊和南洋理工大學聯合推出的多模態大型語言模型(MLLM),基于兩項核心創新來處理視覺數據,預訓練的OryxViT模型和動態壓縮模塊。OryxViT將任意分辨率的圖像編碼為適合LLM的視覺表示,動態壓縮模塊根據需求在1到16倍之間壓縮視覺標記。使Oryx能靈活地處理不同分辨率和時長的視覺輸入,無論是高清圖像還是超長視頻。Oryx在多個視覺-語言基準測試中展現卓越的性能,特別是在空間和時間理解方面。

Oryx的主要功能原生分辨率處理:Oryx能處理任意分辨率的視覺輸入,保留圖像的全部細節,適用于高精度視覺信息的任務。動態壓縮:根據任務需求,Oryx能在1到16倍之間動態壓縮視覺數據,處理長視頻等大規模數據,提高計算效率。多模態理解:理解和分析圖像、視頻和3D數據,提供豐富的空間和時間理解能力,適用于多種視覺-語言任務。上下文檢索:強化對視頻內容的上下文理解,從廣泛的上下文中檢索特定信息。空間感知:Oryx能準確把握3D空間中物體的位置和關系,增強對三維空間的理解。Oryx的技術原理OryxViT模型:預訓練的視覺編碼器,將不同分辨率的圖像轉換為適合大型語言模型處理的視覺表示。自適應位置嵌入:OryxViT使用自適應位置嵌入層,允許模型處理不同大小的圖像,而不需要調整到固定分辨率。變長自注意力機制:允許模型并行處理不同尺寸的視覺數據,提高處理效率和靈活性。區域注意力操作:在動態壓縮模塊中,用區域注意力操作交互高分辨率和低分辨率特征圖,減輕下采樣的影響。混合數據訓練:基于包括圖像、視頻和3D數據的混合數據集進行訓練,提高模型在多模態任務上的性能。Oryx的項目地址項目官網:oryx-mllm.github.ioGitHub倉庫:https://github.com/Oryx-mllm/OryxHuggingFace模型庫:https://huggingface.co/spaces/THUdyh/OryxarXiv技術論文:https://arxiv.org/pdf/2409.12961Oryx的應用場景智能監控:基于Oryx的視頻理解能力,實時監控和分析監控視頻中的事件和活動。自動駕駛:在自動駕駛系統中,Oryx幫助解析和理解車輛周圍的環境,提供更精準的視覺識別。人機交互:Oryx能理解圖像和視頻內容,使人機交互更加自然和高效。內容審核:在社交媒體和在線平臺上,Oryx幫助自動識別和過濾不當內容。視頻編輯和增強:Oryx能自動視頻編輯,如視頻摘要、高光片段生成等。教育和培訓:在教育領域,Oryx提供圖像和視頻內容的智能分析,輔助教學和學習。

Oryx的主要功能原生分辨率處理:Oryx能處理任意分辨率的視覺輸入,保留圖像的全部細節,適用于高精度視覺信息的任務。動態壓縮:根據任務需求,Oryx能在1到16倍之間動態壓縮視覺數據,處理長視頻等大規模數據,提高計算效率。多模態理解:理解和分析圖像、視頻和3D數據,提供豐富的空間和時間理解能力,適用于多種視覺-語言任務。上下文檢索:強化對視頻內容的上下文理解,從廣泛的上下文中檢索特定信息。空間感知:Oryx能準確把握3D空間中物體的位置和關系,增強對三維空間的理解。Oryx的技術原理OryxViT模型:預訓練的視覺編碼器,將不同分辨率的圖像轉換為適合大型語言模型處理的視覺表示。自適應位置嵌入:OryxViT使用自適應位置嵌入層,允許模型處理不同大小的圖像,而不需要調整到固定分辨率。變長自注意力機制:允許模型并行處理不同尺寸的視覺數據,提高處理效率和靈活性。區域注意力操作:在動態壓縮模塊中,用區域注意力操作交互高分辨率和低分辨率特征圖,減輕下采樣的影響。混合數據訓練:基于包括圖像、視頻和3D數據的混合數據集進行訓練,提高模型在多模態任務上的性能。Oryx的項目地址項目官網:oryx-mllm.github.ioGitHub倉庫:https://github.com/Oryx-mllm/OryxHuggingFace模型庫:https://huggingface.co/spaces/THUdyh/OryxarXiv技術論文:https://arxiv.org/pdf/2409.12961Oryx的應用場景智能監控:基于Oryx的視頻理解能力,實時監控和分析監控視頻中的事件和活動。自動駕駛:在自動駕駛系統中,Oryx幫助解析和理解車輛周圍的環境,提供更精準的視覺識別。人機交互:Oryx能理解圖像和視頻內容,使人機交互更加自然和高效。內容審核:在社交媒體和在線平臺上,Oryx幫助自動識別和過濾不當內容。視頻編輯和增強:Oryx能自動視頻編輯,如視頻摘要、高光片段生成等。教育和培訓:在教育領域,Oryx提供圖像和視頻內容的智能分析,輔助教學和學習。